目前我国耕地存在较严重的农药污染问题[1]。无人机低空施药技术结合GPS技术能规划航线施药,但只能全程喷施,并不能按需施药。无人机遥感技术可以快速获取某个重点研究区域的遥感影像及农情信息,从而对作物精准施药,减少化肥与农药的使用,已成为精准农业不可或缺的手段[2-4]。植被指数可以有效地反映植被活力和植被信息,是遥感中最常用的参数之一,也是遥感反演植被叶绿素含量、植被覆盖度、叶面积指数、生物量等参数的重要技术手段[5]。目前应用的植被指数种类很多,但通常为可见光波段与近红外等结合的指数,所需的影像获取成本高、周期长、分辨率不高,很难用于田间的病虫害监测与实时农情信息提取与分析[6]。相比传统遥感,无人机的多光谱遥感可见光波段的图像易于采集、空间分辨率高、获取成本低[7],若能与无人机喷施技术结合,将为无人机精准农业、病虫害分析等研究领域提供新方法。构造一种通用而有效的基于可见光波段的无人机低空遥感图像处理方法是无人机进行精准施药、实时农情监测等的关键。本文针对仅包含可见光波段的超低空遥感图像,开展图像校正、可见光植被指数信息提取与作物区域提取等一系列研究,找出一种低成本的基于无人机低空遥感图像处理技术的方法,为无人机农业精准施药、农田信息提取等提供参考。

1 材料与方法 1.1 材料试验地点位于广州市天河区岳洲路华南农业大学试验田(23.16°N、113.34°E),属于亚热带季风气候,光热资源充足,雨热同季。主要种植作物是蔬菜与水稻。

本试验采用的是实验室自主搭建的电动四轴无人机(图 1),飞行控制器为APM,带有OSD(On-screen display)功能与气压计等传感器,搭配图传后可以实时显示飞行高度等信息。该平台最大起飞质量可达1.5 kg,采用3S电池供电,空载时续航时间约20 min,最大飞行高度可达500 m。本图像采集系统搭载设备有自稳定云台、数字图传和可见光波段广角摄像机。摄像机型号为COTUO-CS70航拍相机,变焦倍数为4倍。最高分辨率为4 608像素×3 456像素,照片像素1.4×107像素(Mega pixel, MP)。

|

图 1 无人机 Figure 1 UAV |

无人机采用定高巡航飞行模式,相机的镜头始终保持垂直向下, 拍摄时天气状态良好,飞行高度约40 m;定点悬停超低空拍摄。因对波段范围与像点中心位置无严格要求,图像没有进行辐射定标。拍摄的图像均有红、蓝、绿3个波段,所得图像分辨率为4 032像素×3 024像素。

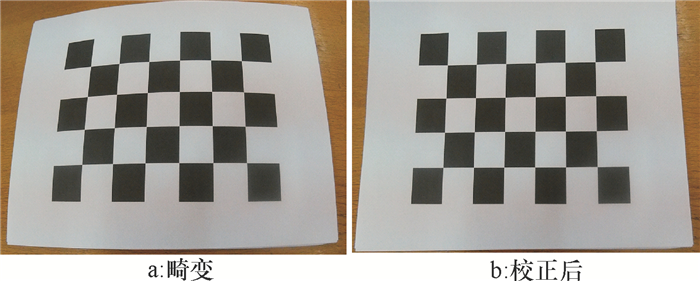

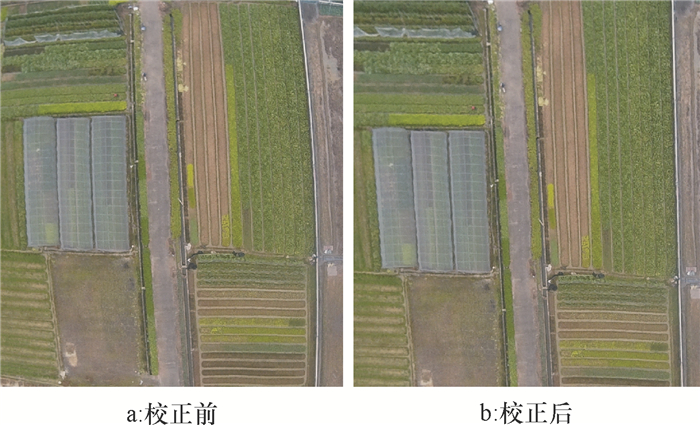

1.2.2 图像的校正及原理无人机成像时,受地形起伏、飞行姿态变化等因素的影响,获得的遥感影像会产生几何畸变。与航天遥感、高空遥感等图像相比,地球曲率、地球自转和大气折射等因素对超低空遥感图像的影响较小,可以忽略[8]。超低空无人机遥感图像的畸变主要是由传感器和地形起伏引发的几何畸变。而本试验中的可见光图片皆为镜头垂直向下拍摄,试验地点地形平缓,相机是普通的广角光学相机,没有经过严格标定,因此影像畸变主要为相机镜头导致的桶形畸变。

遥感图像的几何校正方法主要有基于控制点和基于影像特征的校正。基于控制点的校正主要是利用GPS信息进行的[9]。由于本试验图像是由普通RGB光学相机拍摄所得,照片拍摄时的焦距、相机传感器的物理尺等信息未知,并且存在较大的桶形失真,因此本研究通过Zhang[10]平面标定法来标定相机,获得相机的内部畸变矩阵,并校正试验图片。

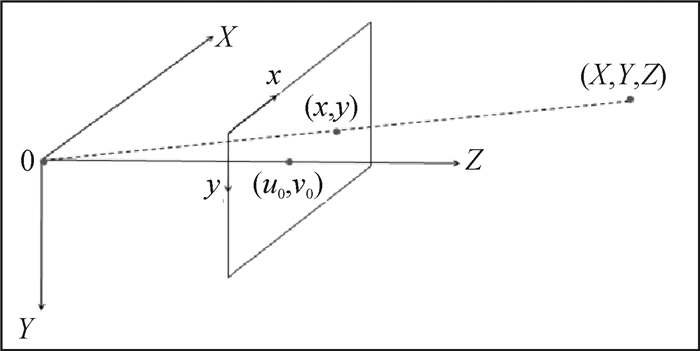

大部分相机成像原理基于针孔模型(图 2)。图 2中(X, Y, Z)是物体在真实世界中的坐标,由用户定义;(x, y)是图像点坐标,是物体投影在成像传感器上所得;(u0, v0)是像主点。

|

图 2 针孔模型 Figure 2 Pinhole model |

根据以上分析,完整的投影方程为:

|

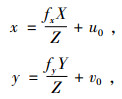

将以上方程改为齐次坐标方程时,用三维向量表示二维向量,用四维向量表示1个三维点。改写后的投影方程如下:

|

式中,S是1个额外的缩放因子。

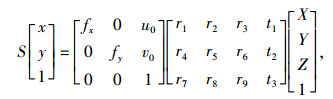

当坐标系不是位于相机投影中心时,就需要加上1个旋转变量(3×3的矩阵)和1个平移向量(3×1的矩阵)。这2个矩阵描述的是刚体变换。因此更通用的投影方程形式如下:

|

式中,r1~r9为刚体变换旋转量,t1,t2,t3为刚体变换平移量。

在使用zhang平面标定法校正图像时,只需用相机从不同的角度和深度拍摄标准国际棋盘纸,然后从上述方程中求出相机的内部参数,继而利用内部参数校正图像。本试验中采用固定棋盘纸而移动相机的方式拍摄,共获得不同角度与深度的棋盘格图像24张,并编程求取相机的内部矩阵。畸变棋盘格与校正后的棋盘格的试验图像见图 3。由获得的畸变矩阵校正后的影像见图 4,为保证校正后图像与原图大小一致,采用1次插值,并编程调整图像大小。

|

图 3 畸变和校正后的棋盘 Figure 3 Distortion chessboard and corrected chessboard |

|

图 4 校正前后的超低空遥感图像 Figure 4 Low altitude remote sensing images before and after correction |

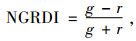

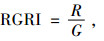

现有的植被指数主要是基于可见光波段与近红外波段,如归一化植被指数(Normalized difference vegetation index,NDVI)、比值植被指数(Ratio vegetation index, RVI)[11]等,有100多种,其所需的遥感图像一般获取成本较高、实时性差、空间分辨率较低。而基于可见光的植被指数主要有归一化绿红差异指数(Normalized green-red difference index,NGRDI)[12]、绿叶指数(Green leaf index,GLI)[13]、红绿比值指数(Red green ratio index,RGRI)、过绿指数(Excess green,ExG)[14]等。上述可见光波段指数计算公式如下:

|

|

|

|

式中,R、G、B分别表示红波段、绿波段和蓝波段像素值,r、g、b分别表示归一化后相应波段像素值。

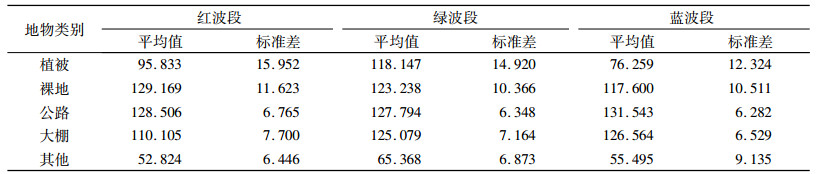

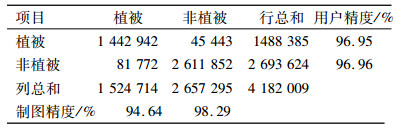

2 结果与分析 2.1 可见光植被指数由于只提取植被,因此将试验的影像文件分为植被与非植被两大类。为了更好地开展指数分析,本文针对每种地物选取10个区域进行统计,并分析各波段间的差异。统计信息如表 1所示。

|

|

表 1 地物在红、绿、蓝3个波段像素值的统计差异 Table 1 Statistical differences of pixel values of surface features in red, green and blue bands |

从表 1中可以看出,对于植被(作物)有绿波段像素值>红波段像素值>蓝波段像素值(像素值为均值),这符合健康绿色植物光谱特性;由于方差较大,数据离散度大,当数据均值较接近时,会存在数据较多的交集。对于非植被与植被,绿波段的植被与非植被会存在较大重合,因此要避免选用只有绿波段的植被指数。

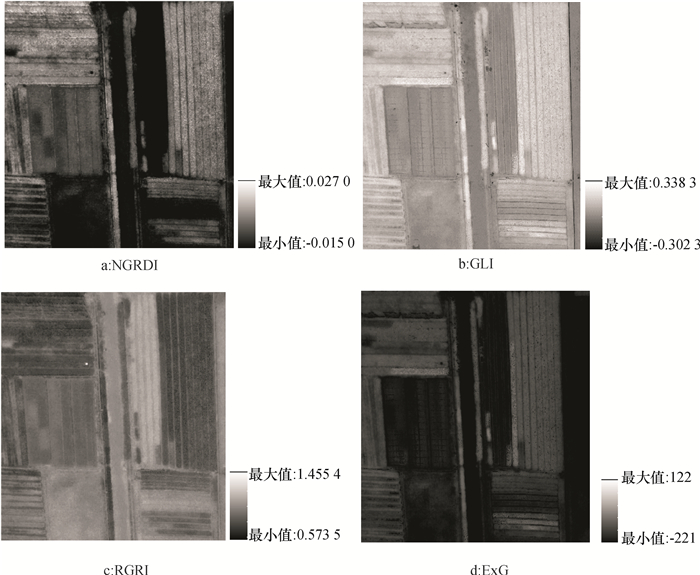

利用可见光波段指数计算公式计算各可见光波段植被指数,可以得到植被指数分布图(图 5)。其中,NGRDI、NGBDI和GLI值的范围为[-1, 1],ExG值的范围为[-255, 255]。

|

图 5 植被指数分布图 Figure 5 Distribution images of vegetation index |

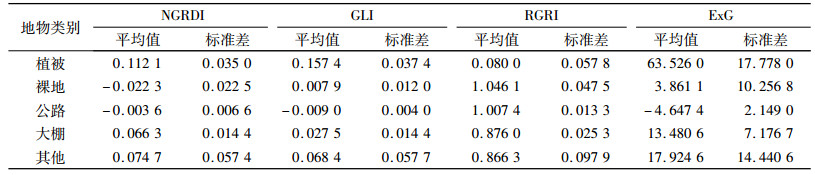

从图 5可以看出,GLI与ExG植被指数分布图的植被与非植被灰度值差异很明显,植被区域呈现亮白色,而非植被区域都比较暗。NGRDI与RGRI植被指数分布图的部分植被与裸地区域灰度值很相近,容易混淆。以上4个植被指数分布图中,RGRI指数分布图的色调越暗表示植被指数值越高,而NGRDI、GLI与ExG指数分布图的色调越亮表示植被的指数值越高。此外,NGRDI与RGRI的部分裸地与植被存在重叠,植被与裸地的交界处细节不够清晰,可能会导致分类精度下降。为了更好地分析各植被指数,采用区域抽样法分别对各植被指数分布图进行特征统计,结果见表 2。

|

|

表 2 NGRDI、GLI、RGRI与ExG的植被指数分布图统计特征 Table 2 Statistical features of vegetation index maps of NGRDI, GLI, RGRI and ExG |

从表 2中可以看出,RGRI指数分布图中各种地物的数值范围存在较大的重叠,其植被提取精度可能会较差,所以不适宜于本试验中无人机遥感图像植被信息的提取。NGRDI指数分布图中植被与其他类别的数值有相交,会造成较大的植被提取误差。GLI与ExG中各地物统计数值没有显著的交叉,表明GLI与ExG比较适合于无人机的农田可见光波段植被信息提取,并且植被与非植被地物数值相差较大,各数值对应方差较小,阈值容易确定。ExG的植被指数值波动较大,与大棚等非植被地物有交叉,可能会出现类别误判。

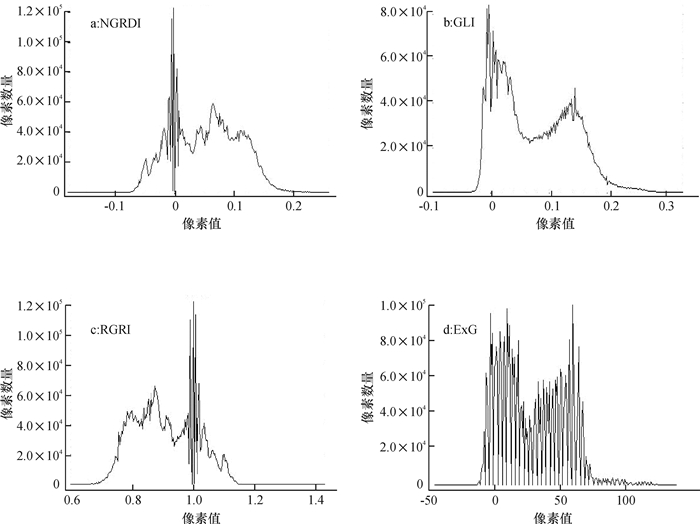

2.2 可见光的植被区域为了确定各植被指数分布图的提取植被阈值,计算得到各指数分布图的直方图(图 6)。

|

图 6 植被指数直方图 Figure 6 Histograms of vegetation index |

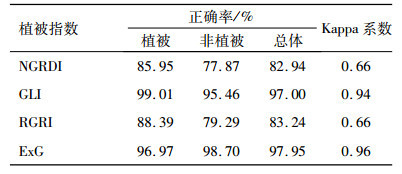

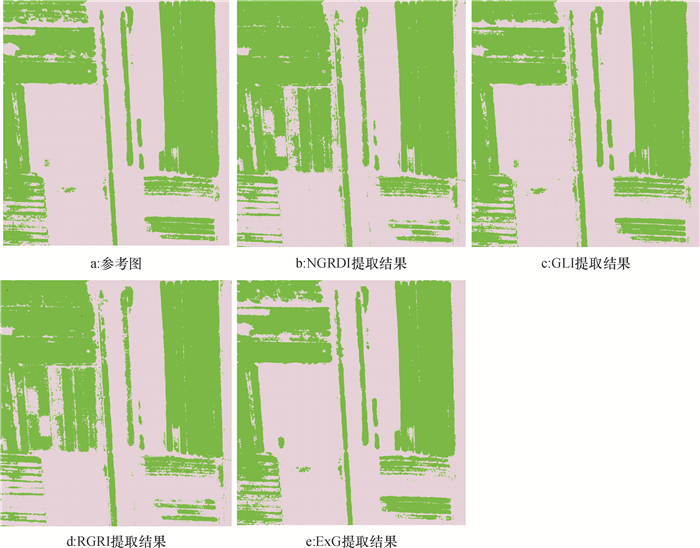

由图 6可以看出,GLI指数直方图具有很强的双峰特性,可以用双峰直方图法求取阈值。其余的指数分布图阈值可以由最大熵值法确定。计算得到植被指数NGRDI、GLI、RGRI与ExG对应的阈值分别为0.052 6、0.077 4、0.895 2和34.549 0。利用确定的阈值对各指数分布图进行植被提取,并进行各植被指数的植被提取精度评价(表 3),植被指数提取结果如图 7所示。图 7a是为评价各指数提取效果的参考提取图。该图由ENVI生成,采用的分类方法为最大似然法,分类精度为99.0%。

|

|

表 3 植被指数提取精度 Table 3 Extraction accuracy of vegetation index |

|

图 7 植被指数提取结果 Figure 7 Extraction results of vegetation index |

从表 3和图 7可以看出,GLI与ExG的提取效果最好,细节部分都能很好地提取,总体精度均大于97%,与参考图像最接近。而NGRDI与RGRI的提取结果中,植被与非植被存在较多的重叠,且植被的提取正确率高,而零星的植被提取效果差,非植被的提取精度差,说明NGRDI与RDRI只适用于成片植被的提取。结果表明,GLI与ExG适用于超低空无人机可见光农田影像的植被提取。

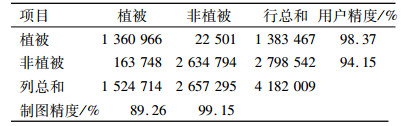

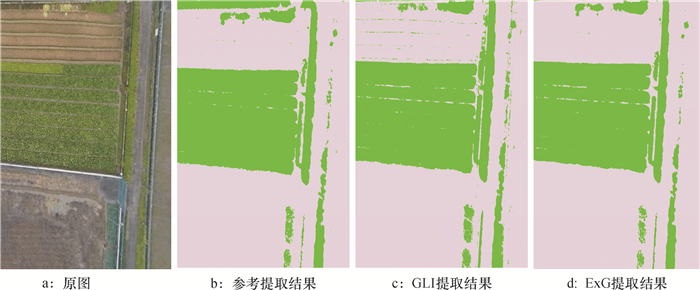

2.3 验证试验图 8为验证试验结果。为了验证该提取方法的通用性与可靠性,选取了同一时间段在该地点拍摄的另一张可见光遥感图像,如图 8a所示,并进行了GLI与ExG植被指数提取,提取植被信息的阈值与上述采用的一致,结果见8c和8d。为了计算验证图像的提取精度,图 8b是为评价各指数提取效果的参考提取图。该图由ENVI生成,采用的分类方法为支持向量机,分类精度为99.1%。通过在参考结果图与GLI、ExG提取结果图中同一位置选取一系列的有用域(Region of interest,ROI),对结果进行统计分析得到误差矩阵表。由误差矩阵表可获得用户精度、制图精度、总体精度,并计算Kappa系数。验证图片误差评价表见表 4和表 5所示。

|

图 8 验证试验 Figure 8 Validation test |

|

|

表 4 验证图片GLI植被信息提取误差矩阵表 Table 4 Accuracy report of GLI vegetation information extraction evaluation form |

|

|

表 5 验证图片ExG植被信息提取误差矩阵表 Table 5 Accuracy report of ExG vegetation information extraction evaluation form |

根据表 4和表 5的误差矩阵,可以算出GLI的总体提取精度为95.54%,Kappa系数为0.90;ExG的总体提取精度为96.96%,Kappa系数为0.93。由此可见,该方法的适用性强,可以较低成本和较高精度获取无人机低空可见光植被指数。

3 结论超低空无人机影像在农情监测、精准农业等领域具有很大的潜力与优势,与卫星影像相比,其空间分辨率更高、获取方式更灵活、时效更好。本研究对无人机可见光影像图像进行了校正,研究了图像中各地物的光谱特征,并结合可见光植被指数NGRDI、GLI、RGRI与ExG等计算得到图像的各指数分布图,在分析各指数分布图的光谱特性与直方图后,进行了植被信息提取并进行了试验验证。结果表明,GLI与ExG指数提取精度很高,准确度都大于97%,与参考结果很接近。验证结果中,GLI与ExG的植被提取精度均大于95%,验证了该方法的适用性与可行性。本文提出的超低空无人机遥感图像处理方法可以用较小成本获取高精度的植被信息提取结果,这对于精准农业、精准喷施、病虫害监测与农情分析等领域有一定的应用价值。

图像校正与指数阈值确定是本研究成功的关键。本研究中的阈值是在样本区域统计中获取的,若能将这个过程自适应化,并且能够提取出不同作物的植被,该方法将具有更广泛的应用范围,这也是下一步研究的工作重点。

| [1] |

李丽, 李恒, 何雄奎, 等. 红外靶标自动探测器的研制及试验[J]. 农业工程学报, 2012, 28(12): 159-163. DOI:10.3969/j.issn.1002-6819.2012.12.026 (  0) 0) |

| [2] |

高林, 杨贵军, 王宝山, 等. 基于无人机遥感影像的大豆叶面积指数反演研究[J]. 中国生态农业学报, 2015, 23(7): 868-876. (  0) 0) |

| [3] |

王利民, 刘佳, 杨玲波, 等. 基于无人机影像的农情遥感监测应用[J]. 农业工程学报, 2013, 29(18): 136-145. DOI:10.3969/j.issn.1002-6819.2013.18.017 (  0) 0) |

| [4] |

李继宇, 张铁民, 彭孝东, 等. 小型无人机在农田信息监测系统中的应用[J]. 农机化研究, 2010, 32(5): 183-186. (  0) 0) |

| [5] |

江洪, 汪小钦, 吴波, 等. 地形调节植被指数构建及在植被覆盖度遥感监测中的应用[J]. 福州大学学报(自然科学版), 2010, 38(4): 527-532. (  0) 0) |

| [6] |

丁雷龙, 李强子, 杜鑫, 等. 基于无人机图像颜色指数的植被识别[J]. 国土资源遥感, 2016, 28(1): 78-86. (  0) 0) |

| [7] |

汪小钦, 王苗苗, 王绍强, 等. 基于可见光波段无人机遥感的植被信息提取[J]. 农业工程学报, 2015, 31(5): 152-157. (  0) 0) |

| [8] |

PRABHAKAR M, PRASAD Y G, VENNILA S, et al. Hyperspectral indices for assessing damage by the solenopsis mealybug (Hemiptera: Pseudococcidae) in cotton[J]. Comput Electron Agr, 2013, 97: 61-70. DOI:10.1016/j.compag.2013.07.004 (  0) 0) |

| [9] |

LIEW L H, WANG Y C, CHEAH W S. Evaluation of control points′ distribution on distortions and geometric transformations for aerial images rectification[J]. Procedia Eng, 2012, 41: 1002-1008. DOI:10.1016/j.proeng.2012.07.275 (  0) 0) |

| [10] |

ZHANG Z Y. A flexible new technique for camera calibration[J]. IEEE, 2000, 22(11): 1330-1334. (  0) 0) |

| [11] |

张正健, 李爱农, 边金虎, 等. 基于无人机影像可见光植被指数的若尔盖草地地上生物量估算研究[J]. 遥感技术与应用, 2016, 31(1): 51-62. (  0) 0) |

| [12] |

TUCKER C J. Red and photographic infrared linear combinations for monitoring vegetation[J]. Remote Sens Environ, 1979, 8(2): 127-150. DOI:10.1016/0034-4257(79)90013-0 (  0) 0) |

| [13] |

LOUHAICHI M, BORMAN M M, JOHNSON D E. Spatially located platform and aerial photography for documentation of grazing impacts on wheat[J]. Geocarto Int, 2001, 16(1): 65-70. DOI:10.1080/10106040108542184 (  0) 0) |

| [14] |

MAO W, WANG Y. Real time detection of between-row weeds using machine vision[C]//2003 ASAE Annual Meeting. Michigan: ASABE, 2003: 1.

(  0) 0) |

2016, Vol. 37

2016, Vol. 37