虚拟装配可以缩短生产设计周期,降低开发成本[1-2]。在农机关键零部件虚拟装配中,单个零件若具备与其结构对应的碰撞体,可具备仿真物理属性;而复杂结构的零件无法自动生成碰撞体,无法批量化、通用化地利用虚拟现实平台强大的物理仿真功能进行仿真测试。为了提高虚拟装配的通用性和实用性,结合人工智能检测识别技术,以农机关键部件三维模型为样本导入虚拟装配平台,通过构建其样本图片数据集训练人工智能分类检测网络,对零件进行分类检测,从三维模型的采样图片中进行零件的分类和碰撞体构建参数的检测;调用相关模块化、参数化碰撞体自动构建程序[3],建立农机关键部件碰撞体模型[4-5],用于批量化通用化生产测试。

构建人工智能分类检测网络的图片样本数据集进行训练,提高训练效率及检测精度,输出足够精确的分类检测参数,是亟需解决的首要问题[6]。首先,SolidWorks、UG、CATIA等三维建模平台具备完善的参数化建模功能[7],但其所建的三维模型在虚拟现实空间内不具备仿真物理属性[8],需通过虚拟现实网络实体建模技术赋予与三维模型贴合的碰撞体使其具备仿真物理属性[9];其次,相对于机器视觉[10-11]、点云重构与建模[12-13]、分类识别检测[14]和智能决策等[13, 15-16]人工拍摄、录制、标记的采样手段,虚拟空间内的采样手段不受时间、地点、自然条件、硬件设备等限制[14, 17],具备采样环境条件可控、数据集精准度高、可批量自动处理等优点[18],同时农机关键部件具备参数标准化、模型特征明确等优点[7],提升自动构建碰撞体的可行性。搜集三维模型数据,通过三维建模平台宏命令接口批量转换三维模型格式[13, 19-21]并导入到虚拟现实引擎中进行采样,构建人工智能检测识别网络的训练样本图片数据集,使用采样优化算法对采样图片进行优化,降低硬件资源损耗,提高网络精度及训练效率[6, 18, 22]。

综上所述,本文提出与虚拟装配相结合的人工智能网络样本图片数据集的构建方法,对农机三维模型样本及采样环境进行优化[17],设计批量处理算法、零件坐标系调整算法,改进零件采样算法,在Unity3D中进行样本数据采集,通过单一变量原则验证该方法每个步骤对分类检测网络训练精度、迭代次数、收敛结果的影响,通过验证对碰撞体构建的相关参数检测结果的精度,为结合人工智能开发虚拟装配平台、提高虚拟装配通用性和实用性提供参考[9]。

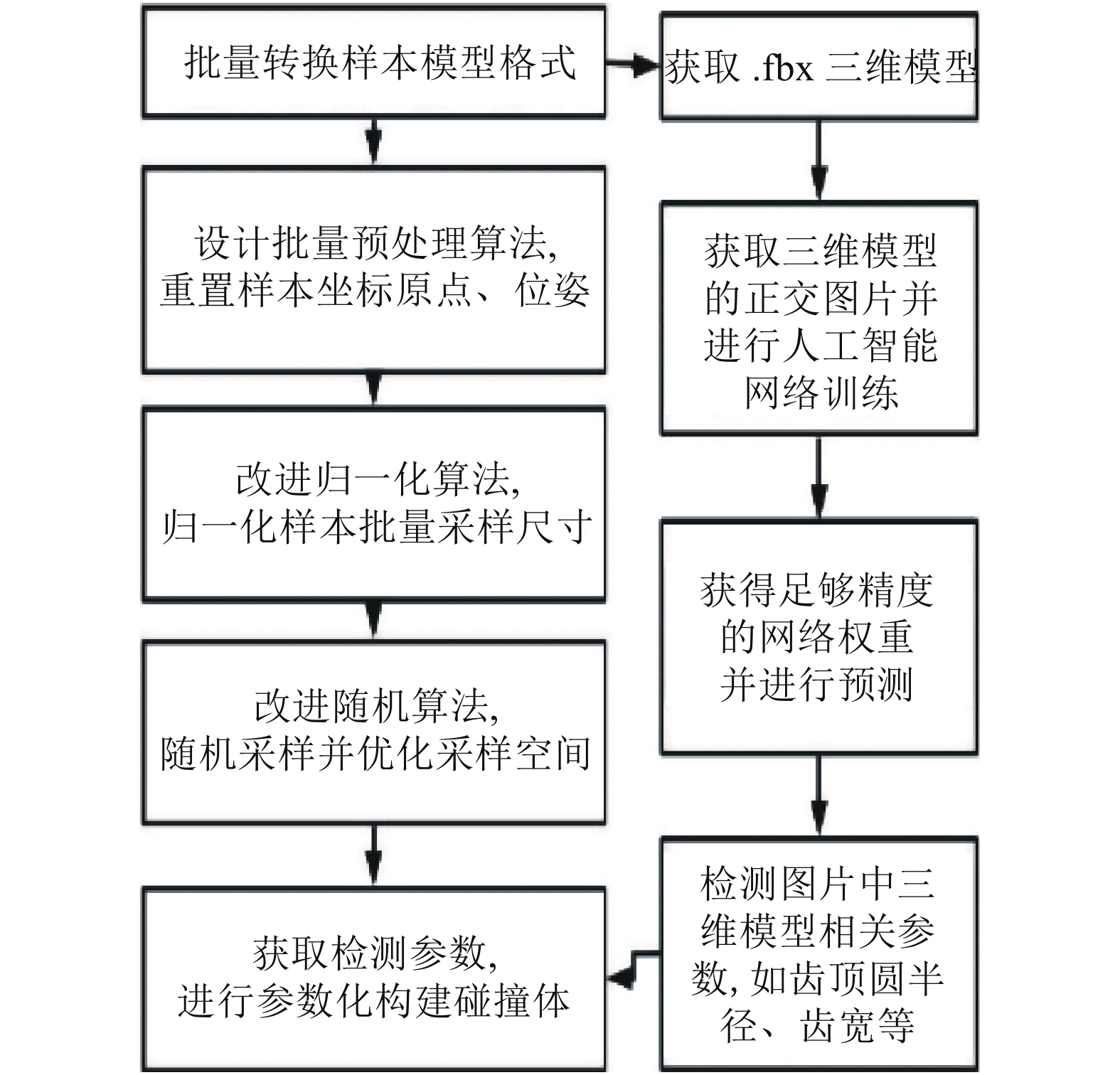

1 样本图片数据集优化处理算法网络及现有数据库需要进行批量格式转换才能导入虚拟现实平台进行三维模型样本采样,构建样本图片数据集,流程如图1。

|

图 1 三维模型样本批量格式转换 Fig. 1 Batch format conversion of 3D model sample |

由于三维模型样本坐标系、姿态等差异极大,需要对其进行坐标系调整、姿态调整,使样本符合选取的采样条件,设计批量预处理算法及改进归一化算法,批量处理样本;同时改进随机算法,控制采样,增加样本图片数据集的采样质量及丰富度。处理流程见图2。

|

图 2 数据集优化处理算法总架构及流程 Fig. 2 General framework and flow path of data set enhancement algorithm |

通过Unity3D内置包围盒——立方体、球体、车轮体、网格体,检测样本的大致尺寸;归纳总结样本种类为轴承、紧固环、啮合套、轴套、齿轮、轴、拨叉,大部分为旋转体结构;结合分析Unity3D内置包围盒,网格体包围盒因面片多、结构复杂对内存消耗大,且不支持非凸体网格实体,具备刚体属性,球体及车轮体包围盒几何外形与样本贴合程度不高。综上分析,选择立方体包围盒及刚体组件并进行尺寸估算,调整样本缩放比例。

1.1.1 批量预处理算法原理及过程由于样本建模原点与质心不重合、采样姿态不规则,样本出现超出采样空间、特征残缺等现象,影响样本质量及网络检测精度,需要重建三维模型样本在虚拟现实中的自身坐标系。

获取样本包围盒质心的世界坐标[23],改进立体相交扫描算法,通过有限次迭代建立以立方体包围盒质心为原点的正交坐标轴系。其流程(图3)及公式如下所示。

|

图 3 计算包围盒正交坐标系 Fig. 3 Calculate the bounding box orthogonal coordinate system |

| $ {A_i}x + {B_i}y + {C_i}z = 0,$ | (1) |

| $ \sqrt {({{p}_{{i}}}^{j}-{{p}_{{i}}}^{(j+1)})^{2}}>{\rm{d}}l,$ | (2) |

| $ p_{i}^{j} = \left[ {x_i^{j},\;y_i^{j}} \right],$ | (3) |

| $ r = x_i^{j} \times \cos \theta + y_i^{j} \times \sin \theta ,$ | (4) |

| ${\overrightarrow {m_a^j} = \left[ {r_a^j,\;\theta _a^j} \right]},$ | (5) |

| $\sqrt {{{(\overrightarrow {{m_a}^j} + \overrightarrow {{m_b}^k} )}^2}} < {\rm{d}}m,$ | (6) |

| $L \div {\rm{d}}l = n_p,$ | (7) |

| $ \sqrt {{{\left( {n_a^j - n_p} \right)}^2}} < 4,$ | (8) |

式中,

公式(1)到(8)为简化改进后的霍夫直线检测过程[24]:通过控制刚体平面旋转与立方体包围盒相交,检测刚体平面内的碰撞边界点;当存在4条直线边界,计算直线簇围成的多边形长宽比和斜率比;当直线两两平行且对边相等,则此时刚体平面法向为质心坐标轴系的其中一个轴,取此轴为公式(1)的刚体平面法向量,重复以上流程再通过叉乘求解剩余坐标轴,便可求解零件质心正交轴系。过程示意图如图4:蓝色边框上按公式(2)进行等距取点,并使用霍夫直线检测直线数量。

|

图 4 坐标轴系建立部分过程示意图 Fig. 4 Schematic diagram of partial process of coordinate axes establishment |

经过父物体包裹进行坐标转换,使样本包围盒质心坐标系重合,公式如下:

| $P_{\rm{o}}+\left[ {\begin{array}{*{20}{c}} {{x_{\rm{f}}}} \\ {{y_{\rm{f}}}} \\ {{z_{\rm{f}}}} \end{array}} \right] - \left[ {\begin{array}{*{20}{c}} {{x_{\rm{o}}}} \\ {{y_{\rm{o}}}} \\ {{z_{\rm{o}}}} \end{array}} \right] = P_{\rm{o}}^{'},$ | (9) |

| $ \overrightarrow {{A_{{\rm{f}}}}} \times \overrightarrow {{A_{\rm{o}}}} = \overrightarrow { n},$ | (10) |

| $ M = {R_x}( - \alpha ) {R_y}\beta {R_z}\theta {R_y} (- \beta) {R_x}\alpha , $ | (11) |

| $ {M_x} {M_y} {M_z} {E_{\rm{o}}} = E_{\rm{o}}^\prime , $ | (12) |

式中,

公式(9)至(12)分别对质心坐标系各轴进行旋转平移实现坐标转换。通过重建质心坐标系,使零件质心坐标系原点坐标处于关键装配基准位置。拨叉的质心坐标系原点在其轴孔位置中心基准轴上(图5),为关键装配位置。各类零件(拨叉、紧固环、轴、齿轮)创建立方体包围盒初始状态如图6所示,包围盒默认按照最小体积计算,包围盒边缘与零件质心坐标系坐标轴平行,重建零件质心坐标系各坐标轴即可求解立方体包围盒各边的方向。

|

图 5 调整坐标系 Fig. 5 Adjust the coordinate system |

|

图 6 创建包围盒 Fig. 6 Create the bounding box a:拨叉,b:紧固环,c:轴,d:齿轮 a: Fork, b: Ring, c: Bearing, d: Gear |

由于不同平台格式转换比例不一致,样本尺寸相差较大影响样本图片数据集的特征清晰度。基于数据集归一化思想,控制样本尺寸处于较小尺寸范围内。

1.2.1 归一化参数选取:样本三维模型通过虚拟相机进行采样,构建图片数据集,其尺寸与虚拟相机分辨率紧密关联;而样本图片数据输入人工智能网络中进行训练受到GPU显存的限制,无法使用太高分辨率的样本图片进行训练,需采用常用训练集图片分辨率。统计包围盒尺寸属性,估算数据样本最大尺寸,拟定样本最佳归一化尺寸及相机采样分辨率。部分包围盒最大尺寸数据如下:gear_ (490) 1.911 100,gear_ (491) 4.714 046,gear_ (492) 1.683 589,gear_ (493) 1.020 409。

当缩放比小于1,部分样本采样效果比图7a更小,无法分辨其特征,如图7e;当缩放比大于6,则部分样本超出采样空间,特征残缺,如图7f。调整样本缩放倍数至1到6,拟定960 × 960分辨率的虚拟相机进行采集,选取其中差异明显,且特征保留及清晰程度相对合理的缩放比例对比如图7。

|

图 7 样本不同缩放比例效果对比 Fig. 7 Effect comparison of different sample zoom levels |

通过图7对比,图a为原始比例,图b缩放比为2,图c缩放比为4,图d缩放比为6,虚拟相机的采样分辨率为960 × 960。当缩放比为4时,样本投影面积占样本图片面积的比例约为40%~60%,特征保留清晰;当缩放比小于4时,特征面积占图片总面积的比例小于40%,特征保留程度相对较低;当缩放比大于4时,少数样本也易超出采样空间,特征残缺。选取缩放比例为4的任意样本进行测试,效果如图8所示。

|

图 8 缩放比例为4的样本 Fig. 8 Sample with zoom level of four |

首先遍历预处理采集样本三维模型包围盒尺寸,调整缩放比例,使尺寸在较小范围内波动。公式如下:

| $ {S^{i}} \times \left( {\frac{{{X_{{\rm{best}}{\rm{ }}}}}}{{X_{{\rm{max}} }^{ i }}}} \right) = S_{{\rm{best}}{\rm{ }}}^{i}, $ | (13) |

式中,

处理后获得在最佳尺寸小范围波动的样本数据集合。归一化缩放比导出不同样本对应的缩放比,如下所示;gear_ (490) 2.09,gear_ (491) 0.85,gear_ (492) 2.38,gear_ (493) 3.92。处理前后效果如图9、10所示。通过缩放处理的零件的整体轮廓大小相近,在采样时可获取图7c中较为清晰且特征比例合适的图像特征效果。

|

图 9 缩放前样本 Fig. 9 Samples before scaling |

|

图 10 缩放后样本 Fig. 10 Samples after scaling |

设置透视及正交投影2种虚拟相机的采样阵列,采用样本正交角度位姿及随机位姿2种采样形式,对比训练效果。

1.3.1 布置虚拟相机阵列Unity3D内置2种虚拟相机:透视相机及正交投影相机。2种相机采样方式如图11。图11a为透视相机,图11b为正交投影相机。因透视相机采样受物体位姿位置影响较大,故训练及识别分类过程的采样均采用正交投影相机。

|

图 11 透视相机(a)及正交投影相机(b) Fig. 11 Perspective camera (a) and orthogonal projection camera (b) |

基于三视图,对零件的正视图、俯视图、左视图、右视图进行采样,降低网络识别检测难度。对应不同种类零件,设置多个相机阵列,采样空间为3个立方体作布尔运算相交所得的立方体空间,即图12a红色框,对应图12b的布置示意图。

|

图 12 相机阵列 Fig. 12 Camera array |

真实环境下采样数据集受背景环境杂乱影响,需要进行降噪等预处理减少对训练效率及识别精度的影响;而在虚拟环境下采样,无噪点、相机畸变等影响因素可通过采样环境渲染优化提升数据集质量,如采用纯黑色背景,选取光线反射低、颜色单一且无纹理的材质,添加充足的光源等。

1.4 改进随机算法提升数据丰富度 1.4.1 求解采样空间使用正视、左视、右视、俯视4个正交方向进行正交投影相机的布置,每个相机的采样范围相交为一个封闭的长方体空间。封闭的长方体空间尺寸取决于每个相机的采样位置及分辨率大小,示意图如图12所示。

考虑到网络训练效率,选取常用采样分辨率2 560 × 2 560、1 960 × 1 960、1 440 × 1 440、960 × 960、480 × 480、320 × 320这6种尺寸,分别进行试验,获取图片样本进行训练,分析分辨率与显存之间的关系对训练过程的影响以及分辨率对样本特征清晰度的影响,选取最适合本开发平台计算机及使用的深度学习网络的样本图片分辨率,各训练曲线如图13所示。

|

图 13 不同分辨率的训练曲线 Fig. 13 Training curve with different resolutions |

表1对比分析图片分辨率与显存的关系:当分辨率为960 × 960以上时,在开发环境为CPU英特尔i5-9400m、内存32 G、GPU英伟达1650super条件下,以每次迭代抓取32个样本进行训练,将出现显存不足等问题,若减少抓取样本个数,则出现迭代过慢等问题;当分辨率处于480 × 480以下时,损失值大,不收敛。

|

|

表 1 不同分辨率的训练数据 Table 1 Training data with different resolutions |

图14采用基于边缘信息空间域[25]方法检测不同分辨率样本图片中特征强边缘扩散程度,以此为指标对比样本图片的分辨率对保留样本特征的影响。使用水平及竖直sobel算子对进行梯度二值化处理,获得图像水平及竖直方向上强边缘,强边缘特征占图片总像素比例越高,表示强边缘扩散程度越高,则清晰度越低,反之亦然。随机选取某零件的各分辨率采样图片进行强边缘特征检测处理,处理结果如图14所示,使用OpenCV逐个像素检测,统计所有不为黑色RGB值的像素的数量占图片总像素的比例,不同分辨率强边缘像素占比分别为320 × 320:12.40%,480 × 480:9.68%,960 × 960:8.32%,1440 × 1440:24.57%,1 960 × 1 960:22.76%,2 560 × 2 560:15.49%。得出如下结论:在遵循特征清晰度足够高的前提下,选取960 × 960为最适分辨率,其对应的采样尺寸为最佳样本归一化尺寸,相对于480 × 480及其余分辨率,此分辨率的保留特征清晰度高,训练迭代效率相对合理。此时采样空间对应为960 × 960 × 960的立方体空间,如图12a。

|

图 14 不同分辨率样本强边缘检测处理结果 Fig. 14 Strong edge detection processing results of samples with different resolutions |

通过网络搜集及数据库积累的样本数量有限,无法进一步提升训练集数量级。在相机阵列进行采样时,对样本进行旋转、平移,可使相机阵列获取到零件不同位姿不同角度的样本,提升样本数量级。

为了保证数据集保留完整的样本特征,需要限制样本随机采样位置位姿不超出采样空间,对样本随机采样范围进行计算,公式如下:

| $ R \cdot \left[ {\begin{array}{*{20}{l}} {{x^\prime }}\\ {{y^\prime }}\\ {{z^\prime }} \end{array}} \right] + \left[ {\begin{array}{*{20}{c}} {\Delta x}\\ {\Delta y}\\ {\Delta z} \end{array}} \right] = \left[ {\begin{array}{*{20}{l}} {{x^{\prime \prime }}}\\ {{y^{\prime \prime }}}\\ {{z^{\prime \prime }}} \end{array}} \right], $ | (14) |

| $\sqrt {{{\left[ {{x^{'}},\;{y^{'}},\;{z^{'}}} \right]}^2}} < {\rm{d}}l',$ | (15) |

| $(L^{'} - {l_{\max}}) \times 0.5 = {\rm{d}}l',$ | (16) |

| $\sqrt {2 \times {X_{{\rm{best}}}^2} + {X_{{\rm{best}}}^2}} = {l_{\max}},$ | (17) |

式中,

首先,对采样空间进行空间定位,设置零件位置为采样空间立方体的几何中心,按照公式(14)至(17)对零件进行随机移动及旋转。样本随机处理后效果如图15。

|

图 15 随机位姿所得样本 Fig. 15 Samples with random pose |

对三维模型样本坐标系转换、尺寸归一化、采样空间优化、随机采样等处理步骤进行单一变量验证,使用同种网络训练并检测验证精度、收敛时长、迭代次数,以检验各步骤对识别网络效率提升的作用大小。设置坐标转换为A,尺寸归一化为B,采样空间优化为C,随机采样处理为D,检测验证精度为Accuracy,验证损失值Loss value,采用GoogLeNet多分类网络,迭代次数预设为200次,每种零件样本数量为500个,共7类,以各零件名称为标签,测试集样本每种50个,设置EarlyStopping损失值在一定条件判断为不再下降则停止训练。结果如表2所示。

|

|

表 2 部分检测数据 Table 2 Part of the test data |

如表2所示,不进行样本三维模型坐标转换及尺寸归一化,网络不收敛。其原因在于样本特征清晰度差;不进行采样空间优化,网络识别精度下降;位姿处理对网络识别精度影响较小但网络收敛,其精度略低,其原因在于训练样本特征不完整,泛化性较差;空白对照组通过未经处理的样本图片训练检测识别网络,网络不收敛且精度极低。综上所述,采取完整步骤处理图片数据集对训练有显著提高。ABCD处理的训练过程损失值及精确值如图16。

|

图 16 损失值及精确值迭代变化过程 Fig. 16 Iterative change process of loss value and accuracy |

通过人工智能识别检测网络,对三维模型样本图片进行检测识别,先识别零件种类,再使用OpenCV检测相关尺寸参数,通过预先构建好的参数化建模程序[9]分别对不同零件的不同参数进行检测。以圆柱齿轮为例,对部分同种三维模型的正交图片样本进行检测对比验证,检测结果数据如表3所示。图17a为采样检测的正交图片,图17b为检测结果。白色竖线代表每段齿面特征的齿顶圆半径,竖线端点为齿宽中心与齿轮轴线的交点,通过OpenCV算法处理获取齿顶圆半径及齿面特征的相对位置。在此检测基础上,通过参数化建模接口及其余参数的检测程序进行碰撞体建模。

|

|

表 3 部分三维模型检测数据 Table 3 Partial inspection data of 3D model |

|

图 17 OpenCV检测相关参数示意图 Fig. 17 Schematic diagram of parameters related to OpenCV detection |

由检测数据可得:相对误差总体不超过2%,即零件特征实际检测尺寸的偏差小于理论尺寸的2%。随着三维模型尺寸增大,误差也略微增大;原因在于尺寸归一化后样本经过缩放处理后,样本图片单个像素代表的单位长度也随之增大,对单个像素检测产生的误差由此累积,这是误差放大的主要原因。

3 结论与展望为了提高虚拟装配的实用性和通用性,构建优化算法处理虚拟样本图片数据集,通过批量转换格式、重建三维模型坐标系、归一化样本三维模型尺寸、优化采样环境及使用多相机并行采样等提升检测识别网络训练效率及检测精度,检测识别相关参数进行碰撞体建模;使用单一变量原则对每个步骤的作用效果进行对比验证,说明其影响性。试验证明,此方法处理的样本图片数据集有效提升网络识别检测精度,人工智能网络训练效率及分类识别精度得到有效提升。本方法可应用于更高级的人工智能网络及更复杂的参数检测程序,实现全自动农机部件的碰撞体建模及装配方案的仿真测试。

| [1] |

邹湘军, 孙健, 何汉武, 等. 虚拟现实技术的演变发展与展望[J]. 系统仿真学报, 2004(9): 1905-1909. DOI:10.3969/j.issn.1004-731X.2004.09.015 (  0) 0) |

| [2] |

陈燕, 曾泽钦, 王杰, 等. 收获机虚拟环境模型与仿真平台构建[J]. 农业机械学报, 2019, 50(7): 159-166. DOI:10.6041/j.issn.1000-1298.2019.07.016 (  0) 0) |

| [3] |

邹湘军, 孙健, 何汉武. 虚拟环境下的生产线三维动态仿真及其建模[J]. 组合机床与自动化加工技术, 2004(4): 29-31. DOI:10.3969/j.issn.1001-2265.2004.04.012 (  0) 0) |

| [4] |

SHAO N, DING X, LIU J. Tolerance analysis of spur gears based on skin model shapes and a boundary element method[J]. Mechanism and Machine Theory, 2020, 144: 103658. DOI:10.1016/j.mechmachtheory.2019.103658 (  0) 0) |

| [5] |

朱忠祥, 陈莉, 李山山, 等. 基于虚拟现实的联合收获机底盘虚拟装配关键技术[J]. 农业机械学报, 2013, 44(S2): 262-267. (  0) 0) |

| [6] |

林木, 张永春, 单丽君. 基于强化学习和虚拟现实技术的机械仿真教学系统研究[J]. 中国设备工程, 2020(22): 228-229. DOI:10.3969/j.issn.1671-0711.2020.22.132 (  0) 0) |

| [7] |

刘伟良, 王红军, 邹湘军, 等. 基于知识的变速箱齿轮虚拟设计研究[J]. 华南农业大学学报, 2020, 41(4): 120-126. DOI:10.7671/j.issn.1001-411X.201912024 (  0) 0) |

| [8] |

万华明, 杨丽, 邹湘军, 等. 基于VR技术的几何建模与优化[J]. 苏州科技学院学报(自然科学版), 2009, 26(4): 20-24. (  0) 0) |

| [9] |

李承恩, 邹湘军, 曾泽钦, 等. 基于虚拟碰撞体的弧齿锥齿轮网格实体构建算法[J]. 系统仿真学报, 2021, 33(4): 837-844. (  0) 0) |

| [10] |

LUO L, TANG Y, ZOU X, et al. Vision-based extraction of spatial information in grape clusters for harvesting robots[J]. Biosystems Engineering, 2016, 151: 90-104. DOI:10.1016/j.biosystemseng.2016.08.026 (  0) 0) |

| [11] |

TANG Y, CHEN M, WANG C, et al. Recognition and localization methods for vision-based fruit picking robots: A review[J]. Frontiers in Plant Science, 2020, 11: 510. doi: 10.3389/fpls.2020.00510.

(  0) 0) |

| [12] |

TANG Y, LI L, WANG C, et al. Real-time detection of surface deformation and strain in recycled aggregate concrete-filled steel tubular columns via four-ocular vision[J]. Robotics and Computer-Integrated Manufacturing, 2019, 59: 36-46. DOI:10.1016/j.rcim.2019.03.001 (  0) 0) |

| [13] |

ZHUANG C, MIAO T, LIU J, et al. The connotation of digital twin, and the construction and application method of shop-floor digital twin[J]. Robotics and Computer-Integrated Manufacturing, 2021, 68: 102075. DOI:10.1016/j.rcim.2020.102075 (  0) 0) |

| [14] |

陈燕, 王佳盛, 曾泽钦, 等. 大视场下荔枝采摘机器人的视觉预定位方法[J]. 农业工程学报, 2019, 35(23): 48-54. DOI:10.11975/j.issn.1002-6819.2019.23.006 (  0) 0) |

| [15] |

邹湘军, 孙健, 何汉武, 等. 虚拟环境中多Agent决策的冲突证据合成研究[J]. 系统仿真学报, 2006(4): 1010-1014. DOI:10.3969/j.issn.1004-731X.2006.04.050 (  0) 0) |

| [16] |

吴烽云, 张坡, 邹湘军, 等. 基于复杂部件虚拟装配的智能决策行为[J]. 自动化与信息工程, 2019, 40(5): 1-5. DOI:10.3969/j.issn.1674-2605.2019.05.001 (  0) 0) |

| [17] |

ZOU X, HE H, WU Y, et al. Automatic 3D point cloud registration algorithm based on triangle similarity ratio consistency[J]. IET Image Processing, 2020, 14(14): 3314-3323. DOI:10.1049/iet-ipr.2019.1087 (  0) 0) |

| [18] |

高伟, 王昱霖, 宋笑迎, 等. 基于虚拟现实技术下深度学习环境的构建研究[J]. 软件, 2019, 40(5): 42-46. DOI:10.3969/j.issn.1003-6970.2019.05.009 (  0) 0) |

| [19] |

梁锋, 钟建强, 罗培锋, 等. CATIA VBA二次开发在装配中批量搜索零件的应用[J]. 汽车实用技术, 2021, 46(1): 32-35. (  0) 0) |

| [20] |

齐江飞, 戈北京, 范颖超, 等. Inventor图纸编号和名称批量自动更改方法研究与应用[J]. 科技创新与应用, 2020(4): 167-169. (  0) 0) |

| [21] |

赵仁兵, 刘金科. 基于Unigraphics NX二次开发功能的批量后置软件[J]. 机械制造, 2020, 58(11): 53-58. DOI:10.3969/j.issn.1000-4998.2020.11.016 (  0) 0) |

| [22] |

郭鹏, 张新艳, 余建波. 基于深度强化学习与有限元仿真集成的拉深成形控制[J]. 机械工程学报, 2020, 56(20): 47-58. (  0) 0) |

| [23] |

康文利, 周学辉. 虚拟装配快速碰撞干涉检验算法的研究[J]. 机械工程与自动化, 2010(4): 53-55. DOI:10.3969/j.issn.1672-6413.2010.04.019 (  0) 0) |

| [24] |

张炫, 杨艳. 基于改进随机霍夫变换的直线提取算法[J]. 信息技术, 2017(12): 6-9. (  0) 0) |

| [25] |

张天煜, 冯华君, 徐之海, 等. 基于强边缘宽度直方图的图像清晰度指标[J]. 浙江大学学报(工学版), 2014, 48(2): 312-320. (  0) 0) |

2021, Vol. 42

2021, Vol. 42