2. 岭南现代农业科学与技术广东省实验室 茂名分中心, 广东 茂名 525000

2. Maoming Branch, Guandong Laboratory for Lingnan Modern Agriculture, Maoming 525000, China

传统获取畜禽体尺多采用工具进行人工测量的方式,如使用皮尺、卡尺等工具[1]。物理测量一方面会使畜禽产生应激反应,影响其正常的生长发育,另一方面直接接触畜禽,易导致人畜疾病交叉感染。此外,这类接触式测量不仅耗时耗力,测量精度受人工误差影响,而且极度影响动物福利[2-4]。

随着计算机技术和机器视觉的发展,基于深度相机的应用方向也越来越广泛,面对畜禽的体尺测定痛点问题有了较好的解决方向[5]。利用深度相机对动物体尺进行评定是目前的研究热点[6],研究者们利用深度相机,通过传统视觉处理、深度学习等方法,实现了基于点云的猪、牛、羊等畜禽动物的体尺估测[6-10],而我国鲜见深度相机应用在鸡只的体尺估测研究。同时,国内外关于深度相机应用在鸡只信息获取上的研究也取得了一定的进展。戚超[11]提出基于鸡胴体的数学模型,使用深度相机采集鸡胴体的三维信息,对鸡胴体质量进行预测分类。Aydin[12]提出一种基于深度相机的评估肉鸡的跛足方法,通过采集鸡只与相机的距离信息和鸡只背部姿势,研究鸡只跛行与非跛行的运动行为。Mortensen等[13]提出了一种基于深度相机的图像估测方法,通过分割鸡只点云并提取背部面积,采用神经网络预测体质量。以上研究均利用深度相机提取鸡只的或胴体信息或面积周长或姿态等信息,在分类评级、体质量预估、姿态评估等方向进行研究,但未在鸡只的体尺性状上做出评价。

在鸡只的育种和培育等过程中,体尺性状是反映鸡只生产性能的重要指标[14-15],但目前我国鸡只的体尺性状测定仍以人工观察和人工度量为主[16-19]。利用深度相机进行鸡只体尺估测主要存在2个问题:1)深度相机受原理限制,拍摄的目标边缘存在抖动[20];2)鸡只主体点云有羽毛冗余干扰且特征点难提取。

本文以50日龄的黄羽鸡为研究对象,旨在通过深度相机获取鸡只的关键体尺。首先使用RealsenseD435深度相机采集鸡只的侧视图和俯视图,其次通过不同的预处理方法得到稳定、可靠的鸡只点云,然后针对不同的体尺特征设计不同的提取方法,最后得到体尺估测数据并与实测结果对比分析。

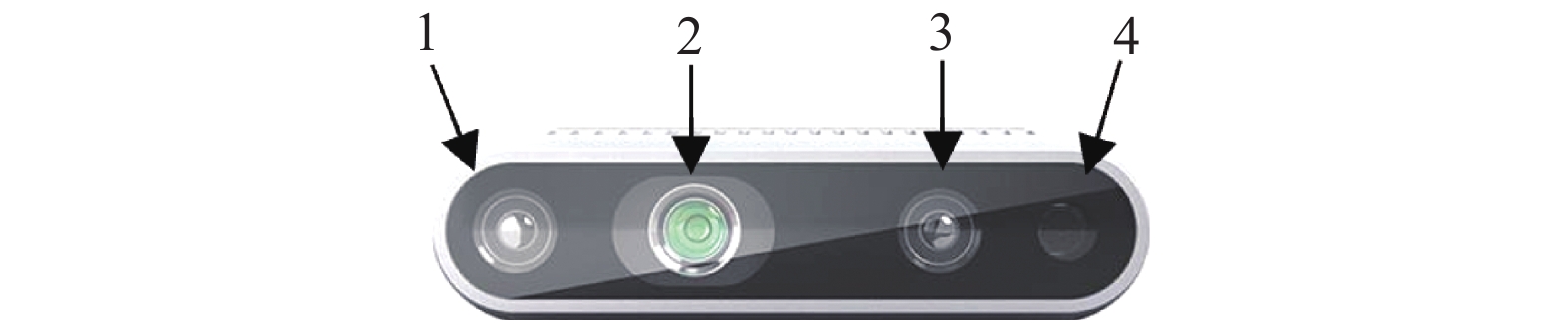

1 材料与方法 1.1 鸡只数据获取 1.1.1 鸡只图像获取本试验采用RealsenseD435深度相机,采用双目红外结构光对实体进行扫描采集数据,相机实物示意图如图1所示。该相机深度视场为86°×57°(±3°),深度最大分辨率为1280×720像素,RGB视场为64°×41°×77°(±3°),RGB最大分辨率为1920×1080像素,理想工作范围为0.2~5.0 m。

|

图 1 RealsenseD435实物示意图 Fig. 1 Physical sketch of RealsenseD435 1:左红外相机;2:红外点射投射器;3:右红外相机;4:RGB相机 1: Left infrared camera; 2: Infrared spot projector; 3: Right infrared camera; 4: RGB camera |

为了保证采集数据的可靠性,对相机精度进行标定。衡量深度图像质量的主要指标有:深度数据精度、数据覆盖率及均方根(Root of mean square,RMS)误差。其中,深度数据精度描述Z方向数据的准确性,覆盖率描述有效像素值的占比,RMS描述拟合的噪声对拟合面的影响。Z轴方向的深度数据精度采用基于图像的距离测量方法,其余指标可通过采用Realsense Self-Calibration工具验证得出。

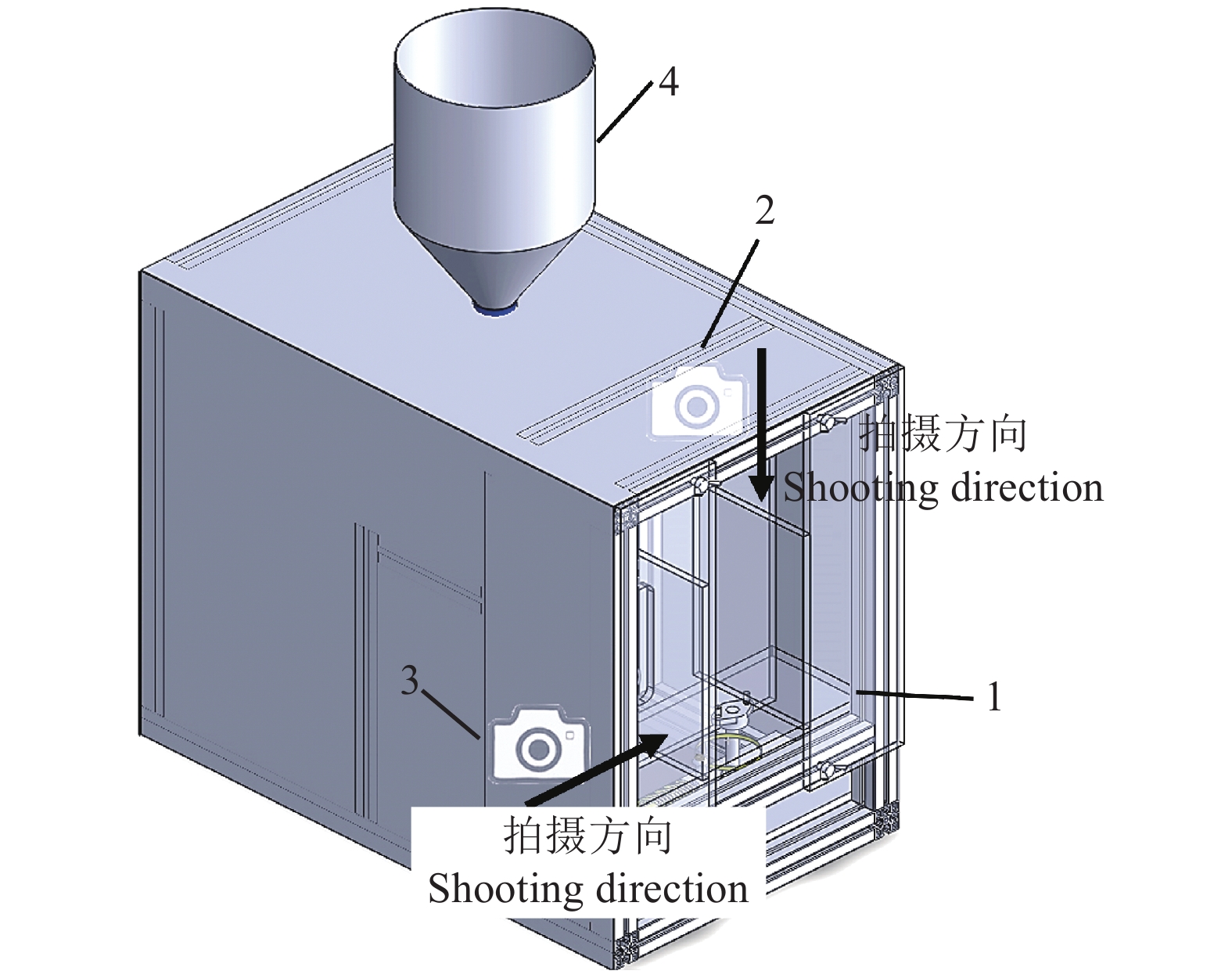

试验数据采集平台示意图如图2所示,相机分别内置在种鸡测定站的上方距平面约0.5 m处和侧方距中心约0.3 m处。该测定站设计有且仅能供1只鸡进出的吃食通道,并可通过读取电子脚环识别鸡只。当鸡只进入吃食通道时,相机开始拍照并与鸡只绑定。于3月26日拍摄采集图像,目标鸡只为日龄约50日的黄羽肉鸡,个体体质量为900~1300 g。

|

图 2 数据采集平台示意图 Fig. 2 Schematic diagram of data acquisition platform 1:种鸡测定站;2:俯视相机;3:侧视相机;4:料筒 1: Breeding chicken testing station; 2: Overhead camera; 3: Side view camera; 4: Material barrel |

为了2台相机能够获取到同一时刻下的照片,采用相机异步软同步方法,实现2台相机在相同的时间进行触发和捕获照片。此外,D435相机虽支持同时获取深度图和彩色图,但两者的分辨率和视野范围并不一致,需进一步统一对齐。通过相机的内参计算得到两者的映射关系,将获取到的彩色图映射对齐到深度图,获得像素点一一对应的彩色图和深度图,分辨率统一为640×480像素。通过本试验研究发现,鸡只进入采食通道并进行采食通常是连续且短时发生的,进行采食后鸡只会出现俯身。故为了拍摄取到鸡只进入通道到未开始采食的完整图片,设定鸡只进入采食通道时立即触发相机连续拍照3 s,相机帧率为60 fps,即180张。此外,相机刚启动时有5帧左右的模糊画面,为确保相机拍摄能够完全覆盖鸡只进入到采食的过程,每次连续拍摄照片200张,此后再进行人工挑选拍摄到完整站立鸡只的图片。

为了获得更加准确、全面的三维点云,将2个视角的图像转换到统一坐标系下进行融合。采用Zhang[21]的棋盘标定法,计算2个相机坐标系的相对位置关系,再通过坐标变换统一坐标系进行点云融合。

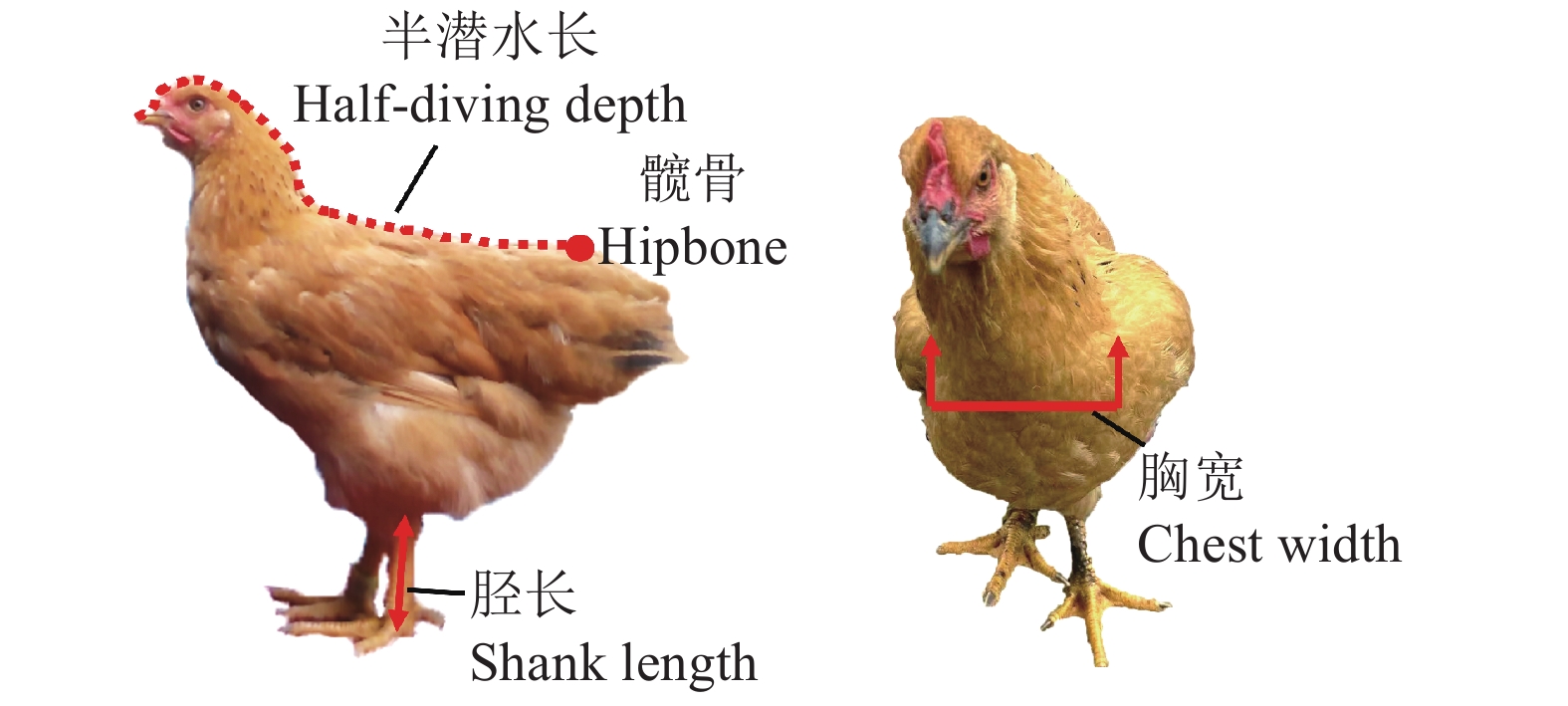

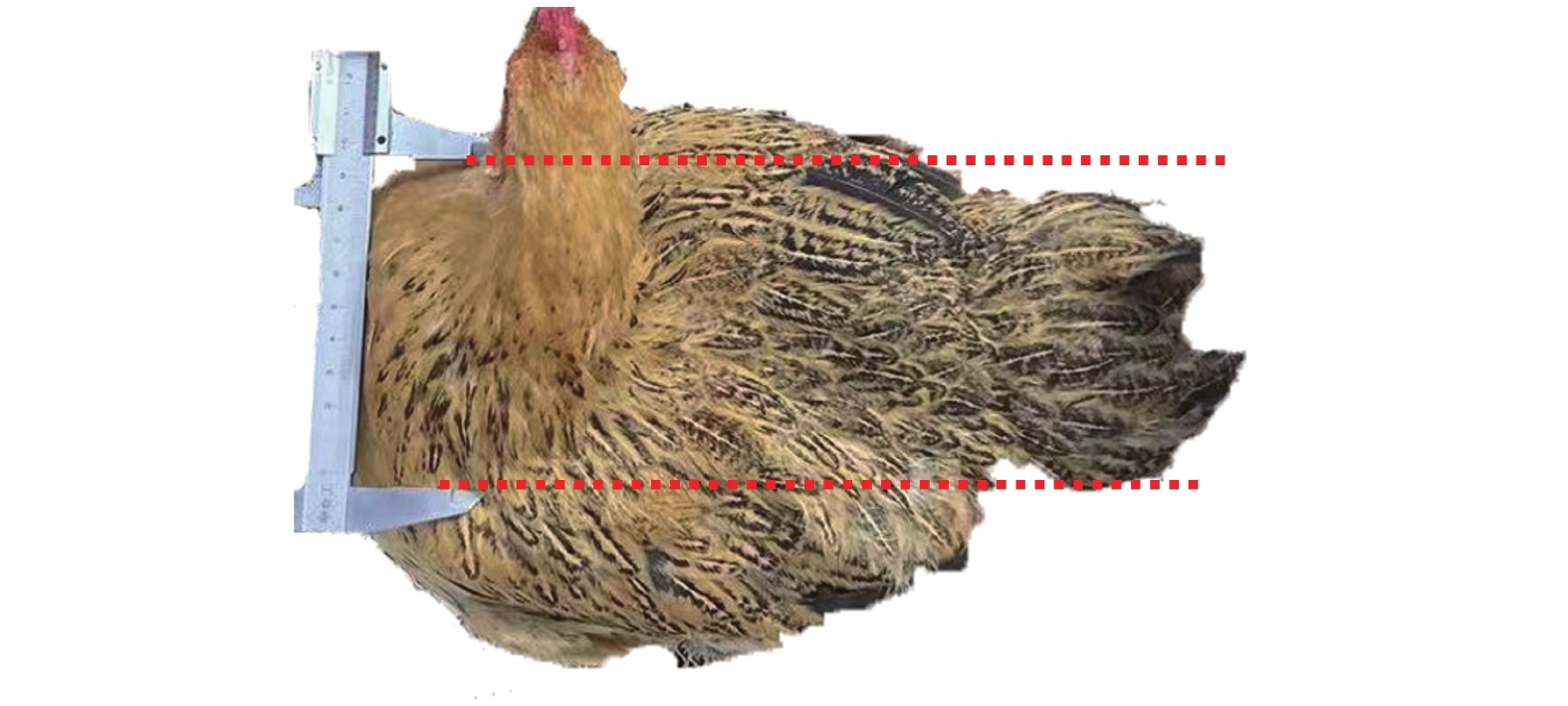

1.1.2 鸡只体尺测定采集照片后,对鸡只体尺逐一进行人工测定记录。本试验共测定鸡只的3个关键体尺:胸宽、胫长、半潜水长(图3)。测量方法依据《家禽生产性能名词术语和度量计算方法》(NY/T 823—2004)[22]:胸宽为用卡尺测量两关节之间的直线距离;胫长为胫部关节到第3、4趾间的直线距离;半潜水长为嘴尖到髋骨连线中点的体表距离。各部位体尺测量3次并取平均值,以减少人工测量误差的影响。

|

图 3 鸡只的3个体尺示意图 Fig. 3 Schematic diagram of three body scales of chicken |

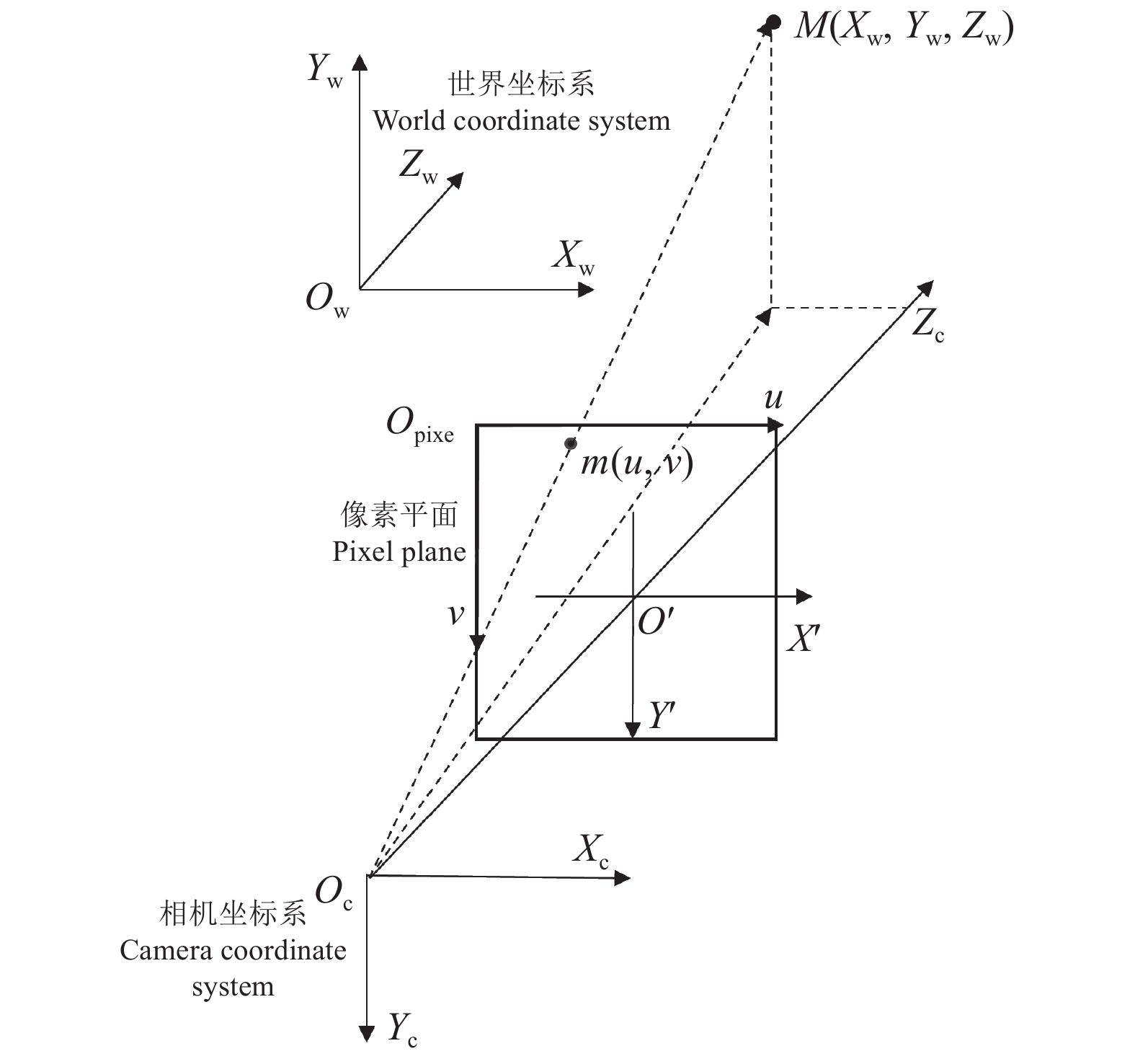

首先将深度图像转换为点云。在深度图像上,每一个像素值都代表了一个三维空间点距离相机的距离。利用相机成像原理,将世界坐标到图像的映射过程用图4表示。

|

图 4 相机与点云变换原理示意图 Fig. 4 Schematic diagram of camera and point cloud transformation m(u,v)为图像坐标系下的任意坐标点;O′为图像的中心点;M(Xw, Yw, Zw)为世界坐标系下的三维点云点 m(u,v) is any coordinate point in the image coordinate system; O′ is the center point of the image; M(Xw, Yw, Zw) is a three-dimensional point cloud point in the world coordinate system |

设R,T分别为外参矩阵的3×3旋转矩阵和3×1平移矩阵,其变换的约束条件为相机内参(dx,dy,fx,fy),则有:

| $ \begin{split} {Z}_{{\rm{c}}}\left(\begin{array}{c}u\\ v\\ 1\end{array}\right)=&\left[\begin{array}{ccc}\dfrac{1}{d_x}& 0& {u}_{0}\\ 0& \dfrac{1}{d_y}& {v}_{0}\\ 0& 0& 1\end{array}\right]\left[\begin{array}{cc}f_x& 0\\ 0& f_y\\ 0& 0\end{array}\begin{array}{cc}0& 0\\ 0& 0\\ 1& 0\end{array}\right]\\ &\left[\begin{array}{c}\begin{array}{cc}{\boldsymbol{R}}& {\boldsymbol{T}}\end{array}\\ \begin{array}{cc}{0}^{1\times 3}& 1\end{array}\end{array}\right]\left[\begin{array}{c}\begin{array}{c}{X}_{{\rm{w}}}\\ {Y}_{{\rm{w}}}\\ {Z}_{{\rm{w}}}\end{array}\\ 1\end{array}\right]。\\[-33pt] \end{split}$ | (1) |

通过以上转换关系即可将深度图像转换到具有三维结构的点云。

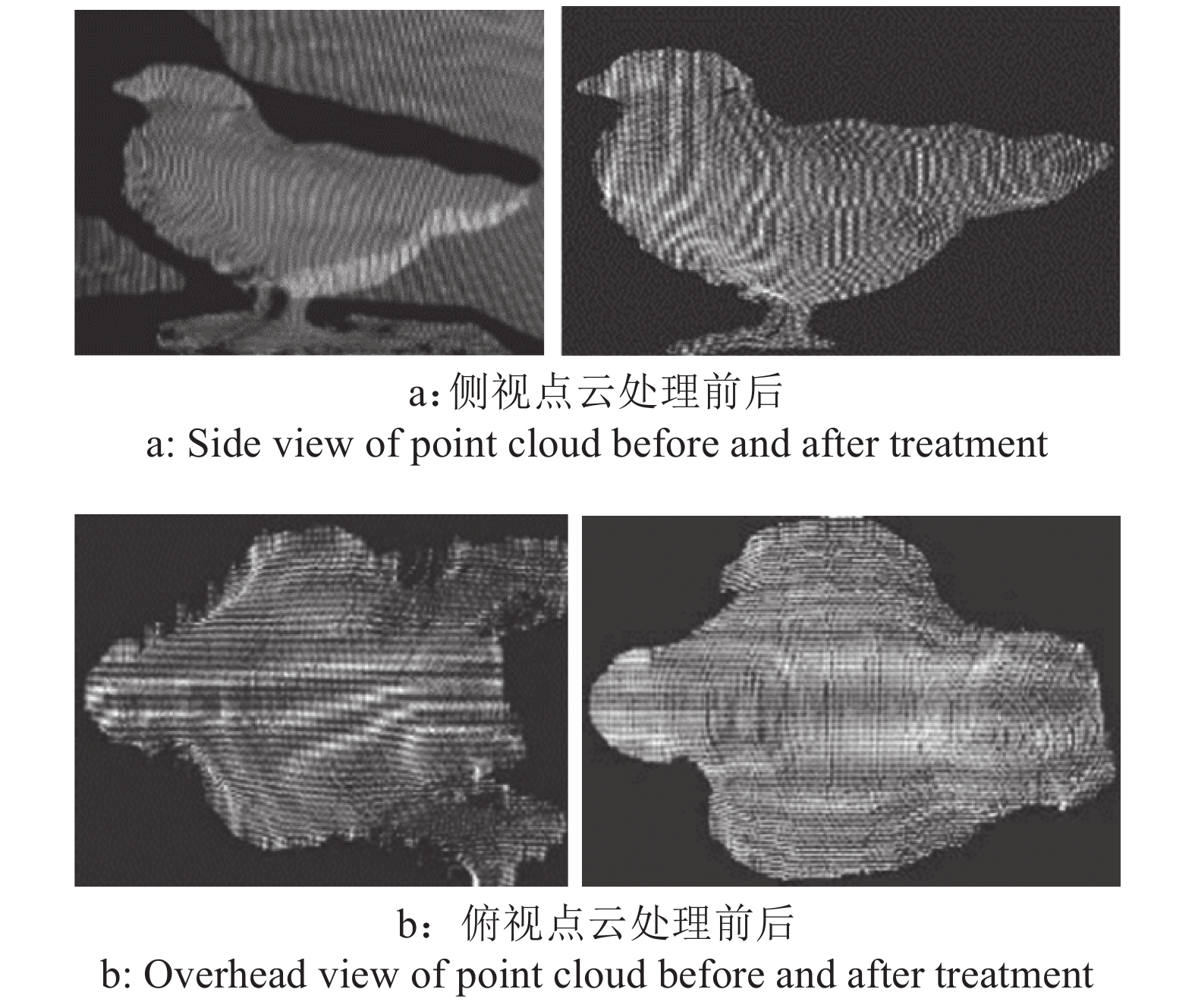

1.2.2 点云预处理在深度图像上,每一个像素值都代表了一个三维空间点距离相机的距离。利用相机成像原理,将深度图像转换为具有三维空间结构的点云,再采用直通滤波方法去除背景信息,半径滤波及统计滤波方法筛除噪点,获得鸡只点云,效果如图5所示。

|

图 5 预处理效果示意图 Fig. 5 Schematic diagram of pretreatment effect |

获取的鸡只点云存在着鸡只点云边缘抖动、鸡尾羽冗余的问题。本文首先采用基于时空特征的边缘平滑方法解决边缘抖动问题,通过连续时间的多帧点云结合空间边缘变化约束,计算边缘点的变化趋势以平滑边缘。针对主体点云的羽毛冗余及特征点难提取问题,结合了鸡只的生物规律,设计了基于生物特征的特征点检测方法,对不同部位的特征点进行识别提取。

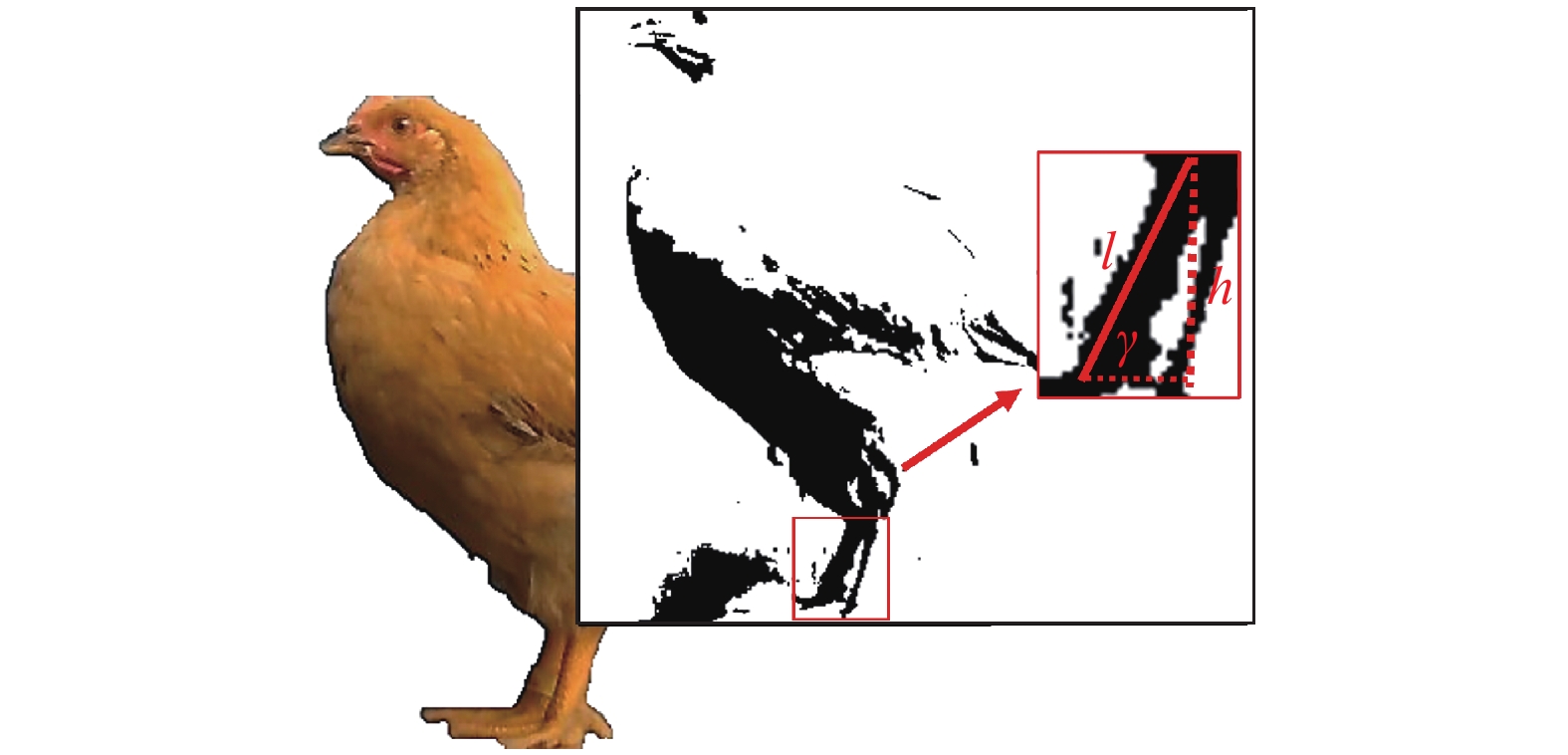

1.3 基于时空特征的边缘平滑D435相机是基于三角测量原理通过红外反射采集深度信息的。因为物体的反射性在边缘部分往往会发生剧烈的变化,导致在边缘处会产生深度数据的不连续,使得深度图像的物体边缘呈现抖动、缺失现象[22-23]。这种相机固有缺陷会影响鸡只特征点提取,进而影响估测结果。鸡只连续帧的边缘剪影如图6所示,连续帧的鸡只边缘是随着时间变化而在边缘发生空间抖动。采用基于时空特征的滤波方法用于平滑深度图像的物体边缘。

|

图 6 连续帧边缘剪影示意图 Fig. 6 Edge silhouette of continuous frames |

为了简便计算,首先将深度图取深度距离的倒数转换到视差域。再取连续多帧图像形成定长的时间序列,每一像素点都形成对应序列,对序列采用指数平均值来衡量数据变化趋势。其次使用序列上的鸡只空间点云相邻像素值变化进行边缘判定约束。最后通过计算指数移动平均值(Exponential moving average,EMA)衡量数据的变化趋势,使用简单的线性变化对边缘点的像素值进行平滑。递推公式如下:

| $ {d}_{t}=\left\{ \begin{array}{l} {d}_{1},\quad t=1,\\ \alpha {d}_{t}+(1-\alpha ){{\rm{EMA}}}_{t-1} ,t > 1 \cap {{\Delta}} \leqslant \theta ,\\ {d}_{t},t > 1 \cap {{\Delta}} > \theta, \end{array} \right.$ | (2) |

式(2)中,

给定序列 {

| $ \begin{array}{c}{{\rm{EMA}}}_{N({x}_{n})}=\dfrac{2{x}_{n}+(N-1){{\rm{EMA}}}_{N({x}_{n-1})}}{N+1}\end{array},$ | (3) |

| $ \begin{array}{c}{{\rm{EMA}}}_{N({x}_{1})}={x}_{1}\end{array}。$ | (4) |

具体步骤如下:

1)将深度图像的像素值取倒数,转换到视差域;

2)取连续N帧图像,按XY轴次序栅格扫描像素值,形成序列{

3)按式(3)、(4)计算相应的EMA值;

4)通过相邻像素点的像素差值

5)将视差域取倒数转换回深度域。

1.4 基于生物特征的体尺估测鸡只体尺特征点是指衡量半潜水长、胸宽、胫长体尺数据的点云关键端点。本文采用的预处理方法,已经将点云边缘进行平滑优化,能够满足特征点的可靠提取。通过分析鸡只的生物特征,针对3个关键体尺进行点云特征点的提取。

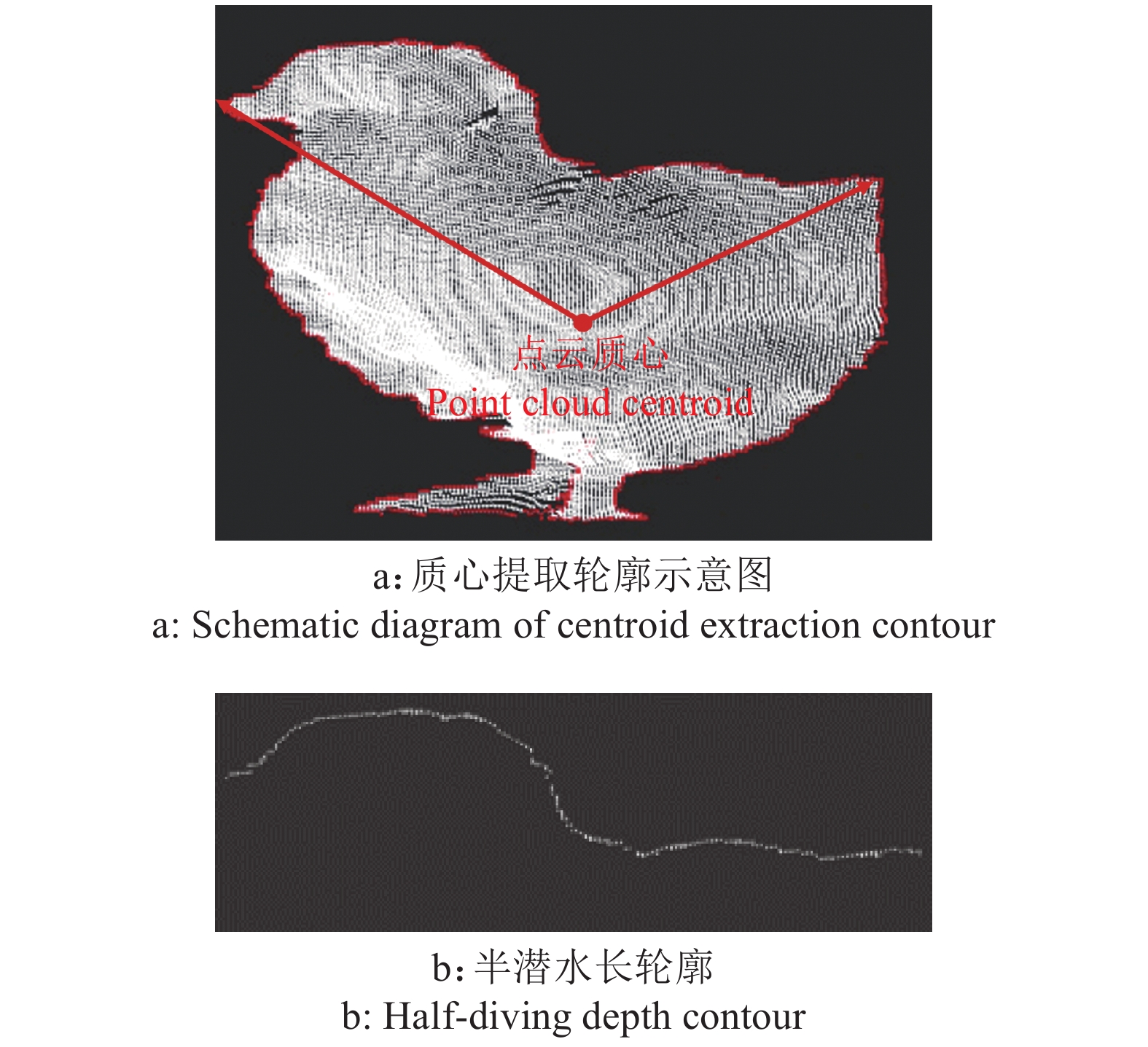

1.4.1 半潜水长特征提取半潜水长为从鸡嘴上缘开始,沿着鸡脖颈、背部直至髋骨中点的体表轮廓距离。而髋骨中点并不能通过图片直接识别。

人工测量时,鸡髋骨中点定位于骨盆腹侧与鸡尾羽毛起点连线附近(图7)。即可将鸡尾羽起始特征点视为髋骨中点特征点,只要获得鸡只嘴尖到鸡尾羽起始点的轮廓,即可计算半潜水长。

|

图 7 半潜水长人工测量点示意图 Fig. 7 Schematic diagram of the manual measurement point for semi submersible length |

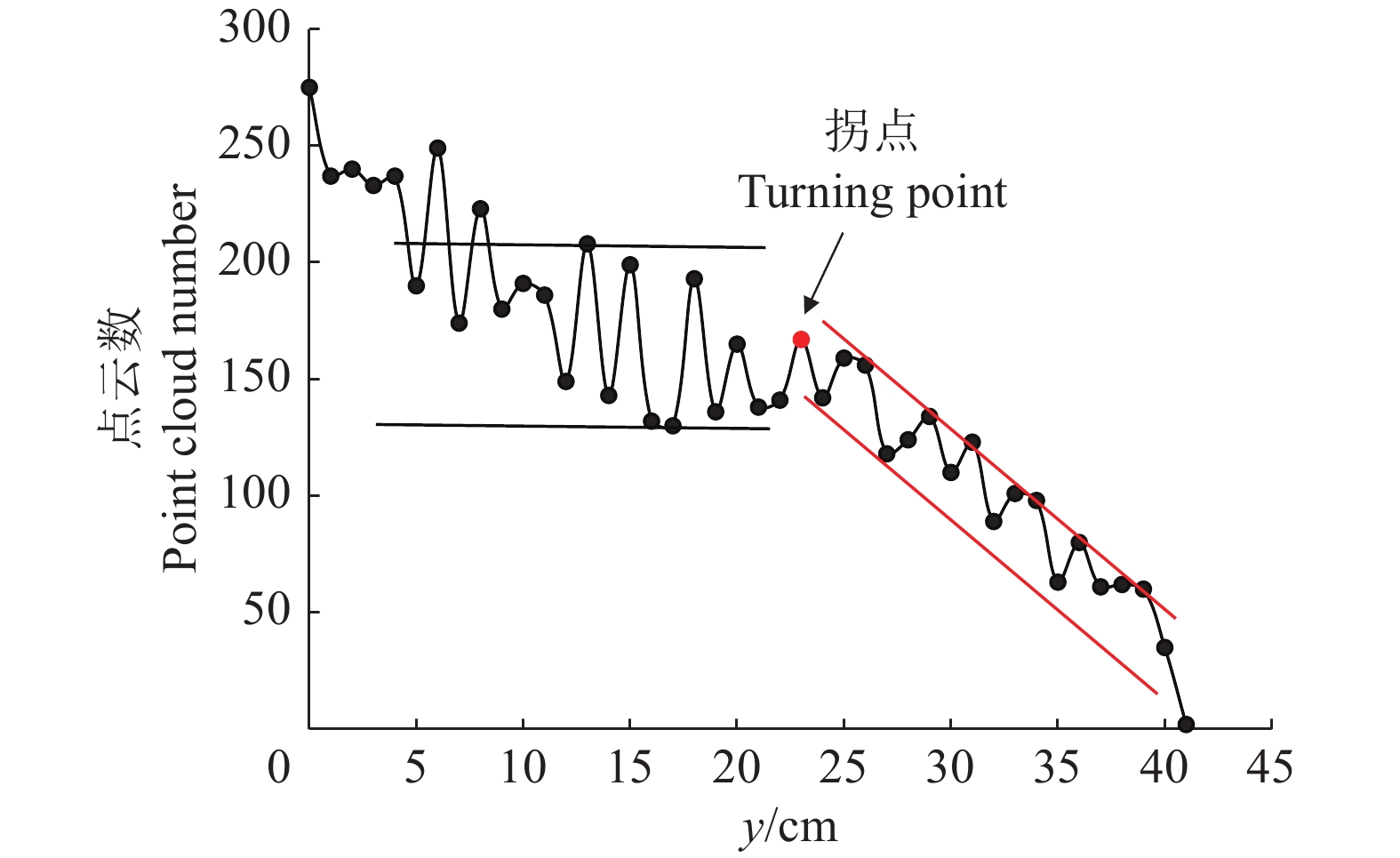

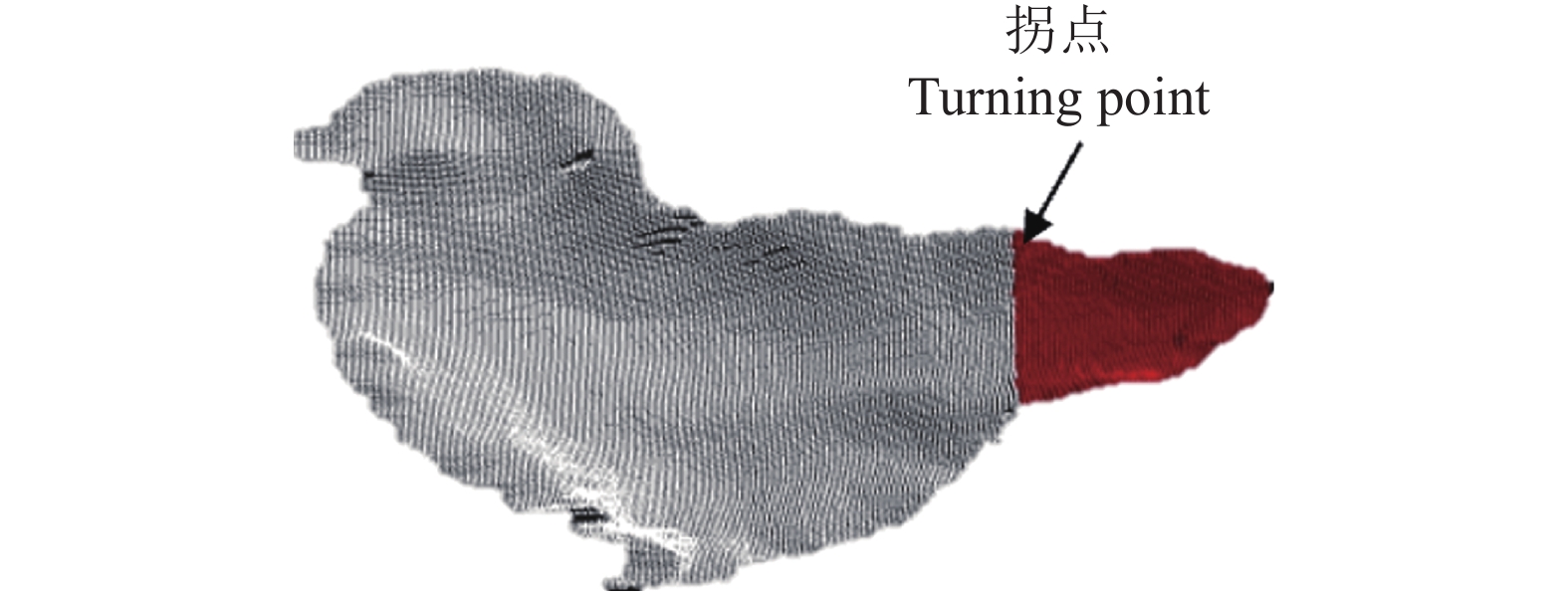

鸡尾羽毛在形态学特征上向外突出,起始点前后一般不存在轮廓上的连续性,故可通过统计点云数定位其鸡尾特征点。在鸡尾起始点,点云数目与鸡身相比连续快速变化。将侧视点云在Z轴方向上进行投影,再以y轴坐标0.5 cm的间隔分区间统计数量,得到分布曲线(图8),将分布曲线的拐点视为鸡尾羽起点,拐点在点云上的位置如图9所示。将主体点云剔除鸡尾羽后,再进行半潜水长的特征提取。

|

图 8 点云数统计图 Fig. 8 Statistical chart of point cloud number |

|

图 9 点云拐点示意图 Fig. 9 Schematic diagram of turning point of point cloud |

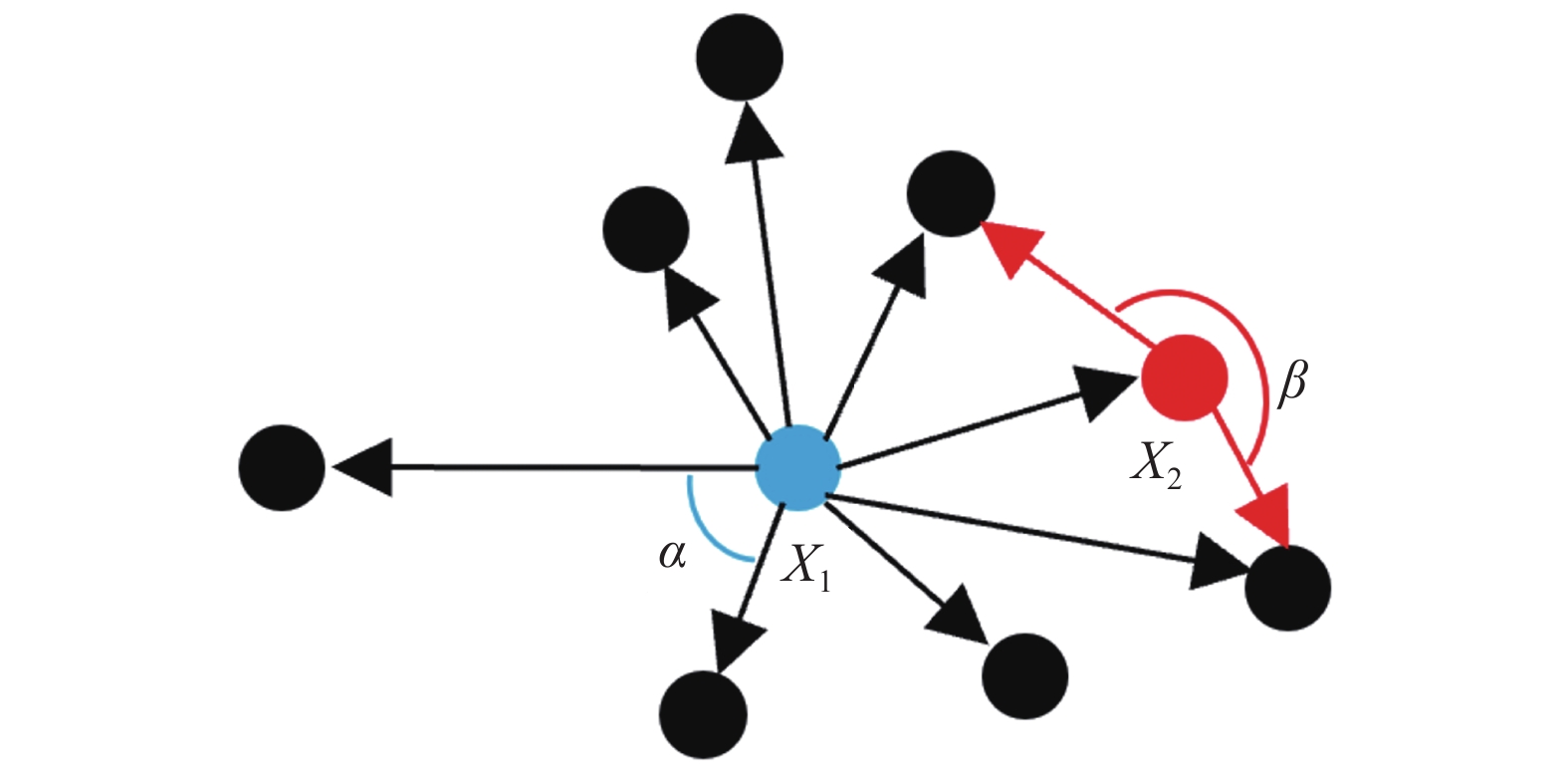

边缘平滑后,需将边缘从主体点云中提取出来以分度计算长度。采用基于邻域分析的边缘提取方法[24],它以采样点与邻域点的夹角大小为依据判断采样点是否为边缘点。如图10所示,作为边缘点

|

图 10 边缘算法原理图 Fig. 10 Schematic diagram of edge algorithm |

|

图 11 剔除尾羽点云边缘示意图 Fig. 11 Schematic diagram of point cloud edge with tail feather removed |

此算法提取的为全图像的轮廓,需进一步对轮廓分段。在鸡只边缘轮廓里,目标线段为:起始点为鸡嘴,终点为剔除鸡尾羽后的鸡只尾部,沿着鸡只上表面的轮廓线段,通过边缘点与点云质心连接线的角度(

|

图 12 上轮廓点云图 Fig. 12 Upper contour of point cloud |

| $ \begin{array}{c}{\theta }_{i}={\mathrm{tan}}^{-1}\dfrac{{r}_{i}(y)-{p}_{c}(y)}{{r}_{i}(x)-{p}_{c}(x)}\end{array},$ | (5) |

式中,

| $ \begin{array}{c}{p}_{c}=\dfrac{1}{M}\displaystyle\sum _{n}^{i=0}{m}_{i}{r}_{i}\end{array},$ | (6) |

式中,M为点的数量,

按顺序计算点之间的欧式距离,并累加结果得到对应的半潜水长(

| $ \begin{array}{c}{l}_{半潜水}=\displaystyle\sum _{i=0}^{n}\sqrt{{({x}_{i+1}-{x}_{i})}^{2}+{({y}_{i+1}-{y}_{i})}^{2}}\end{array}。$ | (7) |

根据鸡只的生物特征结构,鸡只整体呈左右对称结构,其肩关节位于体表左右两端,且肩所在的翅膀为背部左右两端最突出的部位。此外,观察鸡体点云规律,胸宽整体与除去翅膀的鸡身宽相近。人工测量时,用卡尺卡在鸡只两侧测量(图13)。

|

图 13 胸宽人工测量示意图 Fig. 13 Schematic diagram of manual measurement of chest width |

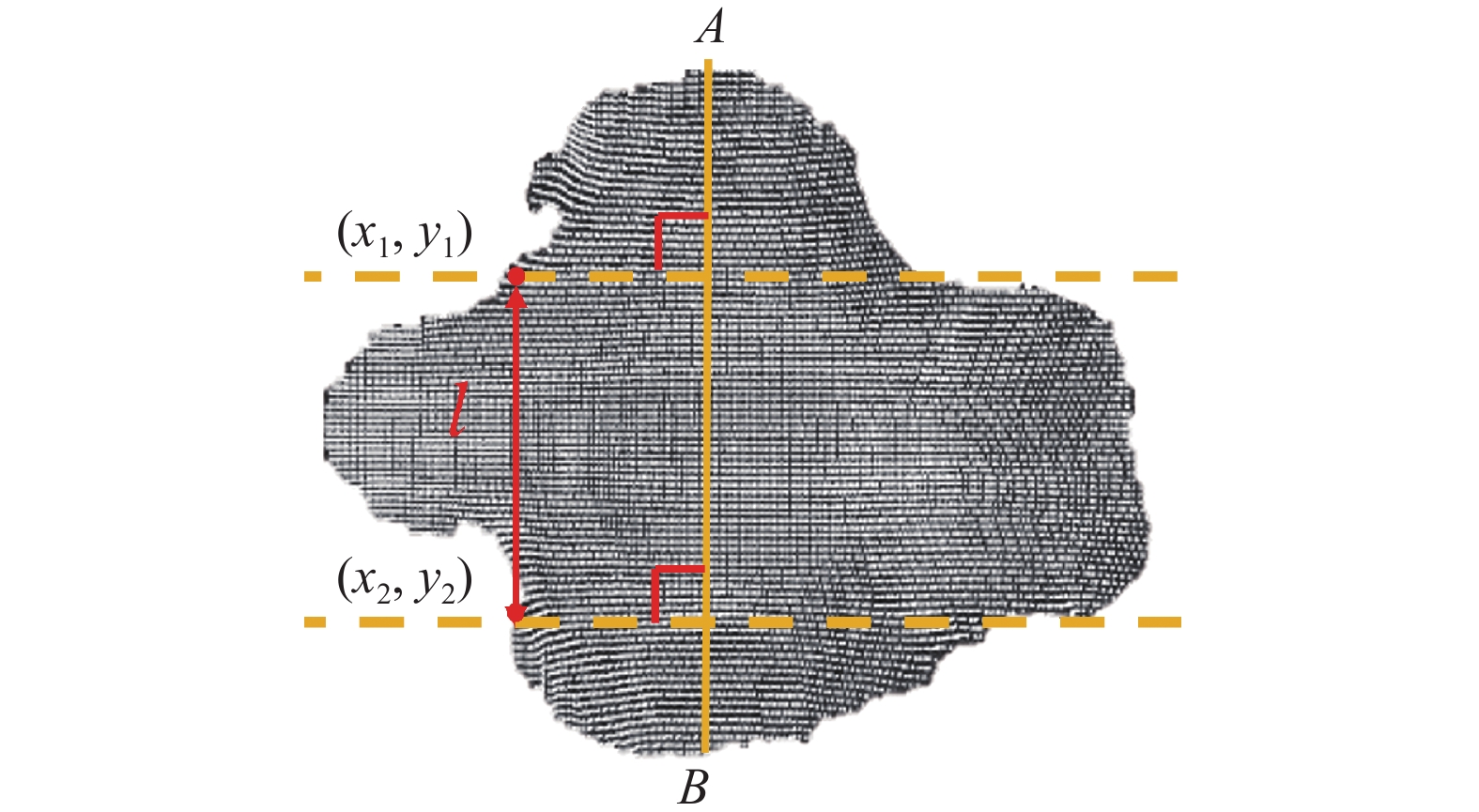

据此,将配准后的点云投影到Z轴零平面上,采用类似寻找鸡尾拐点的方法。如图14所示,找到间距最大的两点A、B,并在鸡只背部点云Z轴方向上逐步平移其垂线,在点云上寻找到经过该垂线且点的数量变化最大的两根线,如图14中虚线所示,将其间距离定义为点云胸宽(

|

图 14 点云胸宽示意图 Fig. 14 Schematic diagram of point cloud chest width |

| $ \begin{array}{c}{l}_{胸}=\sqrt{{({x}_{1}-{x}_{2})}^{2}+{({y}_{1}-{y}_{2})}^{2}}\end{array}。$ | (8) |

胫长的定义为:从胫部上关节到第3、4趾间的直线距离,人工测量一般测量鸡脚气垫到胫部关节的直线距离。从点云上看,因为获取鸡只点云时,鸡只站立在地面上,可将鸡脚气垫与地面视为同一水平面。鸡趾与地面融合难分离,无法直接提取完整的胫特征。

根据鸡只生物特征结构,其站立时的关节高度与胫长应成勾股关系,如图15。只要获取到胫关节的离地高度

|

图 15 胫长关系示意图 Fig. 15 Schematic diagram of tibia length relationship |

首先在点云内寻找胫的起点。用水平的横切面按高度对侧视方向上的鸡点云进行逐行扫描。胫所在的横切面内的点数量较上层横切面必定有骤减,此时即可确定某截面,定义该横截面为胫关节的起点并计算对地的高度

确定起点后,需得出胫对地角度。在点云上,因胫物理尺寸小且与地面融合较难提取特征,故通过RGB图来获取胫的角度。通过记录点云转换关系,即可通过点的位置回溯像素位置。在回溯的像素点位置框选包含胫的方框,设置为感兴趣区域(Region of interest,ROI),并通过Canny边缘检测算法生成边缘图,在ROI区域内采用累计概率霍夫变换(Progressive probabilistic hough transform)拟合直线,得到直线斜率,进而计算胫角度(

| $ \begin{array}{c}{l}_{胫}=\dfrac{h}{\mathrm{sin}\gamma }\end{array}。$ | (9) |

采用基于图像距离的相机精度验证算法及Realsense Self-Calibration工具,分别对0.20、0.25、0.30 m的目标距离进行运算,得到相机质量指标。试验结果(表1)表明,本文试验采用的拍摄距离范围内相机的精度稳定可靠。

|

|

表 1 相机指标数据 Table 1 Camera index data |

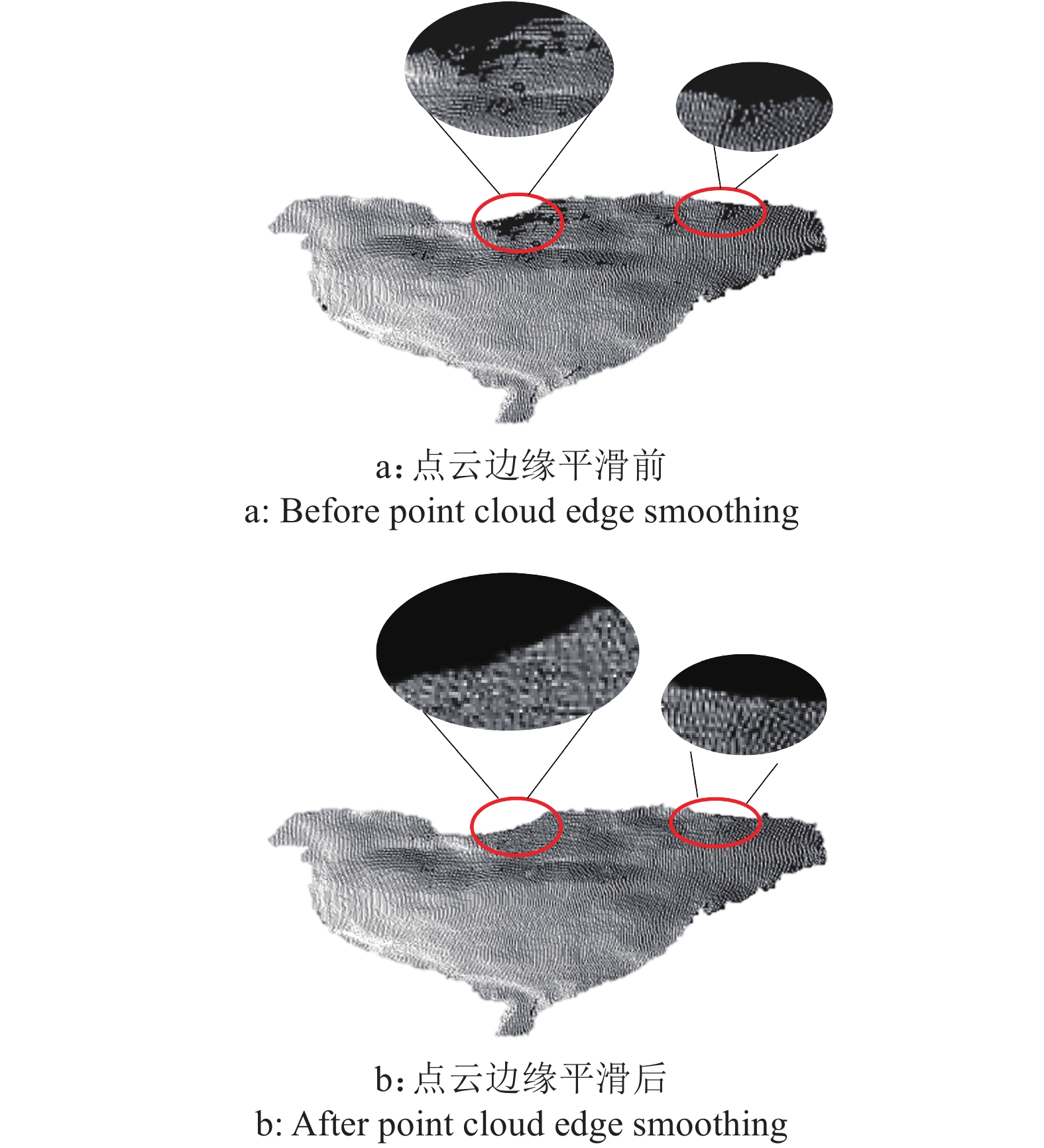

应用本文边缘平滑算法前主体点云边缘有抖动不连续缺失,应用算法后边缘平滑稳定连续(图16)。

|

图 16 点云边缘平滑 Fig. 16 Point cloud edge smoothing |

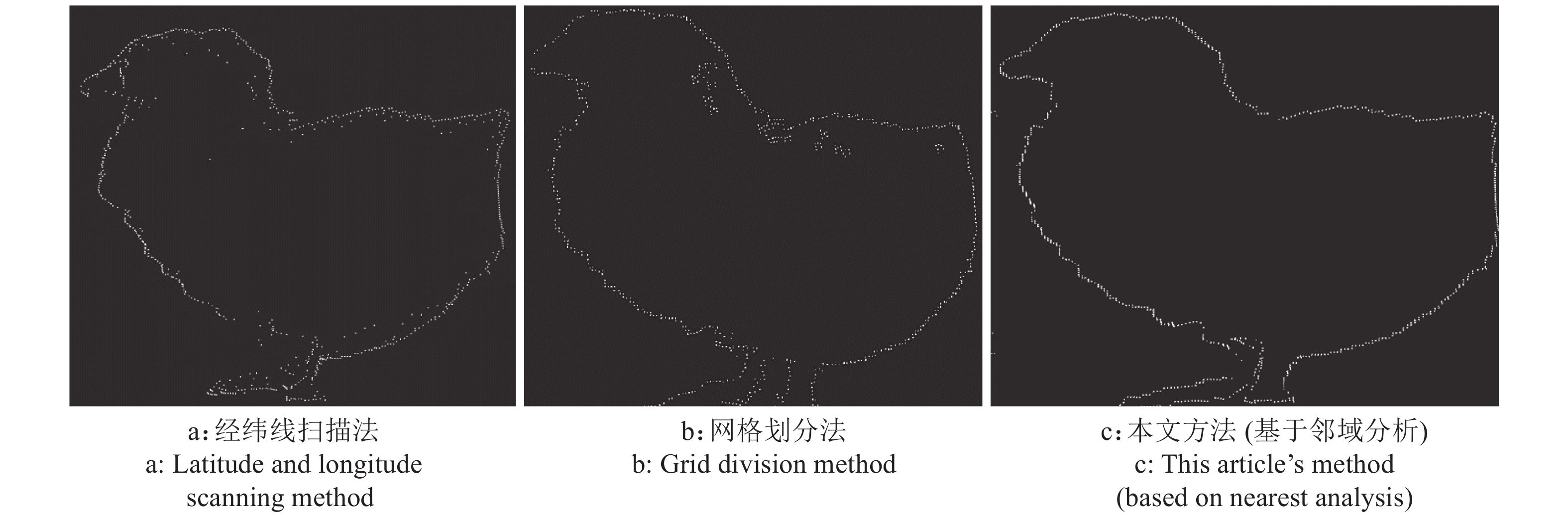

此外,还需进一步提取点云的边缘。边缘提取的准确度决定着体尺估测的结果。为了对比分析本文所用的基于邻域分析的轮廓提取方法与其他轮廓提取方法的效果,使用不同的边缘算法对采集的点云进行边缘提取,效果对比如图17所示。经纬线扫描法边缘不清晰,出现了许多散乱内点;网格划分法边缘虽清晰但出现了小块的密集点簇;本文采用的基于邻域分析的边缘算法边缘连续且密集清晰,符合试验需求。

|

图 17 不同边界算法效果 Fig. 17 Results of different boundary algorithms 图a~c的边界点数分别为800、648和679 The boundary points of figure a−c are 800, 648 and 679, respectively |

对3月26日拍摄的鸡只图进行体尺估测,分别选取黄羽鸡1~5号满足清晰站立条件的各连续10帧图片,每只鸡的数据为1组,按序号分为5组,每组进行2次估测并取平均值。最后与人工测量的体尺平均值数据进行对比分析,结果如表2所示。

|

|

表 2 鸡只体尺数据 Table 2 Body size data of chicken |

胸宽的最大误差为11.85%,最小误差为1.30%,平均误差为6.64%。胫长的最大误差为10.80%,最小误差为2.60%,平均误差为5.93%。半潜水长的最大误差为5.30%,最小误差为0.40%,平均误差为3.34%。平均耗时8.8 s,其中耗时最长的流程是计算点云边缘点,当主体点云外部噪点清除不完全时计算时间变长。

将误差最大的相关点云图进行分析,胸宽估测产生最大误差的原因是背部点云因羽毛影响鸡肩拐点的定位,从而使得估算值有偏差;胫长估测产生最大误差的原因是鸡站立时,两根胫角度相差较大,从而导致拟合直线得到的角度不准确;半潜水长估测产生误差的原因:一是长度以非连续的离散点间的欧式距离计算,会因特征点的变化产生一定的长度倾斜波动;二是鸡只头部及颈部因鸡只活动非严格地处于同一直线,在以直线看待时存在偏差。

3 结论本文通过深度相机采集鸡只的深度图和彩色图,通过点云估测鸡只的胸宽、胫长、半潜水长。针对鸡只点云边缘抖动问题,采用一种基于时空特征的边缘平滑算法,得到的点云边缘连续稳定。针对鸡羽冗余及特征点提取难的问题,提出一种基于生物特征的特征点提取方法,并依据不同部位特点设计了体尺的特征点提取方法,最后对提取的特征点进行估测计算。估测的胸宽平均误差为6.64%,胫长平均误差为5.93%,半潜水长平均误差为3.34%,平均每帧图像计算体尺耗时8.8 s。

综上,本文为鸡只无接触测量体尺提供技术参考,为深度相机在鸡只产业的应用提供了方向。

| [1] |

沈明霞, 丁奇安, 陈佳, 等. 信息感知技术在畜禽养殖中的研究进展[J]. 南京农业大学学报, 2022, 45(5): 1072-1085. (  0) 0) |

| [2] |

JOHNSTONA M, EDWARDSD S. Welfare implications of identification of cattle by ear tags[J]. The Veterinary Record, 1996, 138(25): 612-614. DOI:10.1136/vr.138.25.612 (  0) 0) |

| [3] |

ZARAGOZA O, ENRIQUE L. Evaluation of the accuracy of simple body measurements for live weight prediction in growing-finishing pigs[D]. Champion: University of Illinois at Urban-Champagin, 2011: 1-2.

(  0) 0) |

| [4] |

陈瑶, 张云伟, 雷金辉, 等. 基于视觉的四足动物骨架及行走步态特征提取方法[J]. 电子测量与仪器学报, 2022, 36(2): 68-77. (  0) 0) |

| [5] |

彭孝东, 时磊, 何静, 等. 消费级RGB-D相机在农业领域应用现状与发展趋势[J]. 中国农机化学报, 2022, 43(4): 206-215. (  0) 0) |

| [6] |

张婧婧, 李勇伟. 基于机器视觉的马体尺测量系统设计与研究[J]. 计算机测量与控制, 2017, 25(12): 17-20. (  0) 0) |

| [7] |

尹令, 蔡更元, 田绪红, 等. 多视角深度相机的猪体三维点云重构及体尺测量[J]. 农业工程学报, 2019, 35(23): 201-208. (  0) 0) |

| [8] |

刘同海, 滕光辉, 付为森, 等. 基于机器视觉的猪体体尺测点提取算法与应用[J]. 农业工程学报, 2013, 29(2): 161-168. (  0) 0) |

| [9] |

马学磊, 薛河儒, 周艳青, 等. 基于改进区域生长法的羊体点云分割及体尺参数测量[J]. 中国农业大学学报, 2020, 25(3): 99-105. (  0) 0) |

| [10] |

赵建敏, 赵成, 夏海光. 基于Kinect v4的牛体尺测量方法[J]. 计算机应用, 2022, 42(5): 1598-1606. (  0) 0) |

| [11] |

戚超. 基于深度相机和机器视觉技术的鸡胴体质量在线分级系统[D]. 南京: 南京农业大学, 2019.

(  0) 0) |

| [12] |

AYDIN A. Using 3D vision camera system to automatically assess the level of inactivity in broiler chickens[J]. Computers and Electronics in Agriculture, 2017, 135: 4-10. DOI:10.1016/j.compag.2017.01.024 (  0) 0) |

| [13] |

MORTENSEN A K, LISOUSKI P, AHRENDT P. Weight prediction of broiler chickens using 3D computer vision[J]. Computers and Electronics in Agriculture, 2016, 123: 319-326. DOI:10.1016/j.compag.2016.03.011 (  0) 0) |

| [14] |

赵振华, 黎寿丰, 黄华云, 等. 2个品系肉鸡体尺性状和屠宰性状的典型相关分析[J]. 福建农林大学学报(自然科学版), 2012, 41(2): 166-169. (  0) 0) |

| [15] |

郭宏杰, 马德新. 计算机视觉技术在农业领域的应用[J]. 乡村科技, 2021, 12(14): 119-120. (  0) 0) |

| [16] |

董静超, 陈家雪, 李华, 等. 清远麻鸡慢羽系屠宰性状与体尺性状的主成分分析[J]. 江苏农业科学, 2022, 50(5): 151-155. (  0) 0) |

| [17] |

姜宏正, 杨德智, 马中华, 等. 儋州鸡体尺性状全基因组关联分析[J]. 中国畜牧兽医, 2022, 49(2): 598-607. (  0) 0) |

| [18] |

文杰. 肉鸡种业的昨天、今天和明天[J]. 中国畜牧业, 2021(17): 27-30. (  0) 0) |

| [19] |

XU R, TYASI T L, QIN N, et al. Assessment of relationship between body weight and body measurement traits of indigenous Chinese Dagu chickens using path analysis[J]. Indian Journal of Animal Research, 2017: 588-593.

(  0) 0) |

| [20] |

FU J, WANG S, LU Y, et al. Kinect-like depth denoising[C]//2012 IEEE International Symposium on Circuits and Systems (ISCAS). Seoul: IEEE, 2012: 512-515.

(  0) 0) |

| [21] |

ZHANG Y Z. A flexible new technique for camera calibration[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2000, 22(11): 1330-1334. DOI:10.1109/34.888718 (  0) 0) |

| [22] |

中华人民共和国农业部. 家禽生产性能名词术语和度量统计方法: NY/T 823—2004[S]. 北京: 中国农业出版社, 2009: 3-4.

(  0) 0) |

| [23] |

LIG X, LIUX L, MAY F, et al. Body size measurement and live body weight estimation for pigs basedon back surface point clouds[J]. Biosystems Engineering, 2022, 218: 10-22. DOI:10.1016/j.biosystemseng.2022.03.014 (  0) 0) |

| [24] |

XU G, RUAN P. Point cloud boundary detection in preprocessor of optical-mechanical integrated simulation[J]. Infrared and Laser Engineering, 2016, 45(4): 0428001. DOI:10.3788/irla201645.0428001 (  0) 0) |

2023, Vol. 44

2023, Vol. 44